《阿凡达:水之道》(Avatar: The Way of Water)调色:调色师塔希·特里尤(Tashi Trieu)

背景、技术设置与工作流

从塔希·特里尤在加州橘子郡查普曼大学道奇学院电影与媒体艺术专业最后一年算起,我认识他已经好几年了。我们是由一位共同的导师介绍认识的,他就是科罗拉多州博尔德市GW Hannaway & Associates公司的温德姆·汉纳威(Wyndham Hannaway)。作为图像科学家和视效专家,温德姆参与过一些电影的开拓性的工作,比如原版《星际旅行1:无限太空》(Star Trek: The Motion Picture,1979)。同时,他也认识动态图形艺术家特里·特里尤(Terry Trieu),也就是塔希的父亲。温德姆认为塔希与我在调色和图像工作流方面有很多共同的兴趣,于是建议我们见面认识一下。

旁注: 温德姆·汉纳威是世界一流的老式光学与磁带格式媒体文件修复与恢复专家之一。

我初次去查普曼大学拜访塔希正好是他准备毕业的时候。 他当时正在完成自己的毕业设计影片之一,那部片以35mm拍摄,他利用学院的Spirit 4K胶片扫描仪进行扫描,并用Autodesk Lustre来调色。我们聊天的时候他提到,他已经开始在洛杉矶一家后期公司工作了。

自那之后,我们一直保持着联系,而我持续关注着塔希不断发展的职业生涯。 作为一位DI剪辑师兼调色助理,他参与过业内最大牌的一些电影和系列,包括漫威电影宇宙作品、《星球大战》《怪奇物语》《极速车王》等等。他还曾在Technicolor、EFILM和Company 3工作过,他为史蒂夫·斯科特、迈克·索瓦、托尼·达斯汀和斯基普·金伯尔等调色师担任过助理。

在2019年初,我去EFILM令人惊叹的世界最大调色室——Stage One调光棚——拜访了塔希,当时他刚刚完成《阿丽塔:战斗天使》(Alita: Battle Angel)的DI剪辑和完成片制作,并且在准备《大侦探皮卡丘》(Pokémon Detective Pikachu)。我们聊了很久为《阿丽塔》不同的2D与3D投影技术管理和交付多个版本的流程。我为他深入的技术知识,以及他对于在好莱坞制片厂和后期公司工作细致入微的观察所折服。除了要适应新兴色彩与成像技术的前沿趋势,为全球最大型的一些视效驱动型项目管理复杂的DI,他还对自己的未来以及他如何以不同的方式来工作有着深度思考。

被选中成为《阿凡达:水之道》的DI调色师

在2022年初,我有机会跟塔希叙叙旧,而他带来了一些惊人的消息:导演詹姆斯·卡梅隆(James Cameron)和光风暴娱乐公司选中他来担任酝酿已久的全球影史票房最高影片的续集《阿凡达:水之道》的DI调色师。这部192分钟的史诗级电影有超过3200个视效镜头,以立体3D、48fps高帧率(HFR)拍摄完成,最后需要11个为全球各种投影技术优化的各自的院线交付文件。

自电影于2022年12月16日上映以来,(截至2023年2月)全球票房斩获21亿美元(约合人民币150亿元),把全球观众重新带回了潘多拉星球的世界,世界最大电影IP之一的《阿凡达》(Avatar)系列由此正式建立起来。

2022年6月,塔希去到新西兰惠灵顿的Park Road Post后期公司设置工作环境。他的第一个任务?将原版《阿凡达》(2009)重制为48fps高帧率立体3D院线版,要赶在《阿凡达:水之道》之前重映。重制版相当于为续集要进行的处理流程试水,让塔希和Park Road团队得以彻底测试每一个元素,为《阿凡达:水之道》的调色,以及把詹姆斯·卡梅隆期待已久的构想带给全世界做准备。

经过3个月紧张的调色和完成片制作,《阿凡达:水之道》于(2022年)12月16日全球首映,塔希则放假回到科罗拉多,跟家人团聚。趁他回来的这段时间,我们坐下来畅谈了这部具有里程碑意义的电影的完成片制作细节。

本文将分为前后两篇,带大家从内部了解为这样一部全球电影大作进行调色、完成片制作和交付所涉及的技术、技巧和思考过程。

专业背景

你的背景是怎样的,你是怎么被选为《阿凡达:水之道》的调色师的?

我具有合成以及线上剪辑的丰富背景。我参与的第一部制片厂长片电影是《钢铁侠3》(Iron Man 3),我在其中担任的是额外的DI剪辑师和调色助理,辅助史蒂夫·斯科特(Steve Scott)进行Autodesk Smoke和Lustre的操作。那是第一部在Technicolor公司调的漫威电影,史蒂夫及其团队也刚过来,而我则是“大片”世界的新人。之前,我的工作局限在相对简单的独立电影上,那些项目“图像锁定”了就是真的锁定了,而视效的数量只是几十个,而不是千位数的。

我一边在一家公司做了好几年的线上剪辑工作,一边维持着一批独立调色客户,大部分是我在夜间或周末居家工作完成的。作为调色师,很难在后期公司的世界博得一个位置。而作为履历并不丰厚的年轻调色师,你很难把自己推销出去!

我最终努力坐上了一个混合岗位,作为一名DI剪辑师,兼顾工作流架构师、调色助理和合成师的工作。像《怪奇物語》(Stranger Things)和《超感猎杀》(Sense8)这样的剧集,我真的处理了数千个视效镜头、除错、擦线、复杂光学效果和稳定处理。那时候把很多这些工作外包给视效团队是常规操作,而大部分人处理的都是预解拜耳的DPX或EXR文件。我则推动我们的团队采用摄影机RAW工作,并把套底从Flame/Smoke带到达芬奇里进行,这样我就可以跟调色师在相同的环境里进行原生处理,让我们的职能联系更紧密。我与托尼·达斯汀(Tony Dustin)和斯基普·金伯尔(Skip Kimball)合作,终于在2015/2016年真正启动了这套模式,当时后期公司DI仍普遍采用平展-发布工作流(素材以单一的平展片段交付用于调色,并使用EDL剪辑)。

2016年,我辅助完成了《终结者2:审判日》(Terminator 2: Judgment Day,1991)重制版的线上剪辑,斯基普·金伯尔担任重制调色师。我们至此开始了长期合作,完成的项目包括《怪奇物语》《大侦探皮卡丘》《极速车王》《失控玩家》以及光风暴的另一个项目《阿丽塔:战斗天使》。《阿丽塔》在某些意义上可谓是《阿凡达:水之道》的“带妆彩排”。两部电影有许多共同的摄制组人员、立体摄影机技术和工作流。这是一个非常棒的机会,可以学习如何对同时需要十几个不同交付文件的复杂DI进行协调。

正常来说,一部院线长片的DI有一个标准的放映交付文件,而如果这是一部大片,那就是一个高品质的的大格式交付文件,比如杜比影院(Dolby Cinema)标准。对于《阿丽塔》,我们制作的是3D版,詹姆斯·卡梅隆和乔恩·兰道(Jon Landau)最大的首要任务之一,就是为每一位可能的观众提供他们电影的定制化版本,给予观众尽量最佳的观影体验。

更高级并且拥有更亮放映机的影院会得到为那种亮度等级专门调色的一个版本。

这可没有一体适用的处理方式,所以处理起来很复杂,也很有挑战性。《阿丽塔》中大部分的那些处理都由我来负责。我需要提供一套工作流,让调色师(斯基普)和我可以协同工作,共同完成电影、预告和海量宣发素材的制作。

我在工作流、剪辑、色彩科学以及调色方面的经验让我成为《阿凡达》这样的项目的理想人选,这当中处处是挑战。

搬到新西兰进行后期制作流程是什么体验?

相当直截了当。一部典型的制片厂电影的调色师,通常会为他们签约或有合作伙伴关系的公司工作。他们会跟那家公司绑定,通常他们负责的内容会在那家后期公司完成,得到该公司所有其他员工的帮助,获得该公司提供的辅助服务。我曾在Technicolor和EFILM(后来在Company 3)工作过,但我决定我想尝试一些不一样的东西,看看能否再次从事客户这端的工作。2015年,我浅浅尝试了一下,成为Bad Robot的内部人员,参与了《星球大战7:原力觉醒》(Star Wars: The Force Awakens)。

在制作端作为电影人团队进行工作,跟作为一家后期制作公司的员工,工作体验完全不同。

对于《阿凡达:水之道》,我是制作方雇佣的,跟其他摄制组成员一样,工作氛围跟我之前参与制片厂电影完全不同。这更像是我参与独立项目,只需应对电影人(我的客户)和我之间的关系。这是这么鸿篇巨制的电影可以达到的最简单直接的关系了!

后期公司、团队与技术设置

在Park Road Post公司工作是什么感觉?

虽然这家公司跟好莱坞隔了半个地球,但惠灵顿是一个非常棒的创作中枢,这里有大量影视人才。彼得·杰克逊(Peter Jackson)在那里创立了一个公司网络,可以包揽制作的全流程。大部分真人实拍是在他的Stone Street Studios拍摄的,就在维塔数码(WetaFX)和Park Road Post的马路那头。维塔数码是这部片的主力视效公司,跟他们的密切合作起到决定性作用。

Park Road是个非常棒的工作地点。你可把它想成天行者牧场(Skywalker Ranch),但一切都集中在一栋楼里,并且位于一个寂静的城郊。我们的画面和声音都是在Park Road完成的,那意味着阿詹(卡梅隆昵称“Jim”)和乔恩(制片人乔恩·兰道)可以按其所需在混音和调色师之间跳转。

你的团队是怎样的?

为这部电影进行完成片制作最棒事情之一,就是我们小而精的图像完成片团队。我曾参与过有5名调色师、若干助理、多位剪辑师和一大堆统筹和制片人的项目。我并不认为那样的流程就比小型团队更高效或更高产。我是完全可以自给自足的,并且我有很强的技术背景,所以我发现,一般对我来说,完成那些一般由调色助理来做的很多事情会简单得多,而且不会因为他人传话而丢失细节。

图源:乔恩·兰道

光风暴的吉奥夫·伯迪克(Geoff Burdick)是我们的图像总监,他监督所有立体3D相关事宜,以及从素材获取到分发的整个管线。罗比·百利高(Robbie Perrigo)作为光风暴吉奥夫团队的一员,对于我们在图像剪辑、视效制作和图像完成片之间的工作流运作起到至关重要的作用。

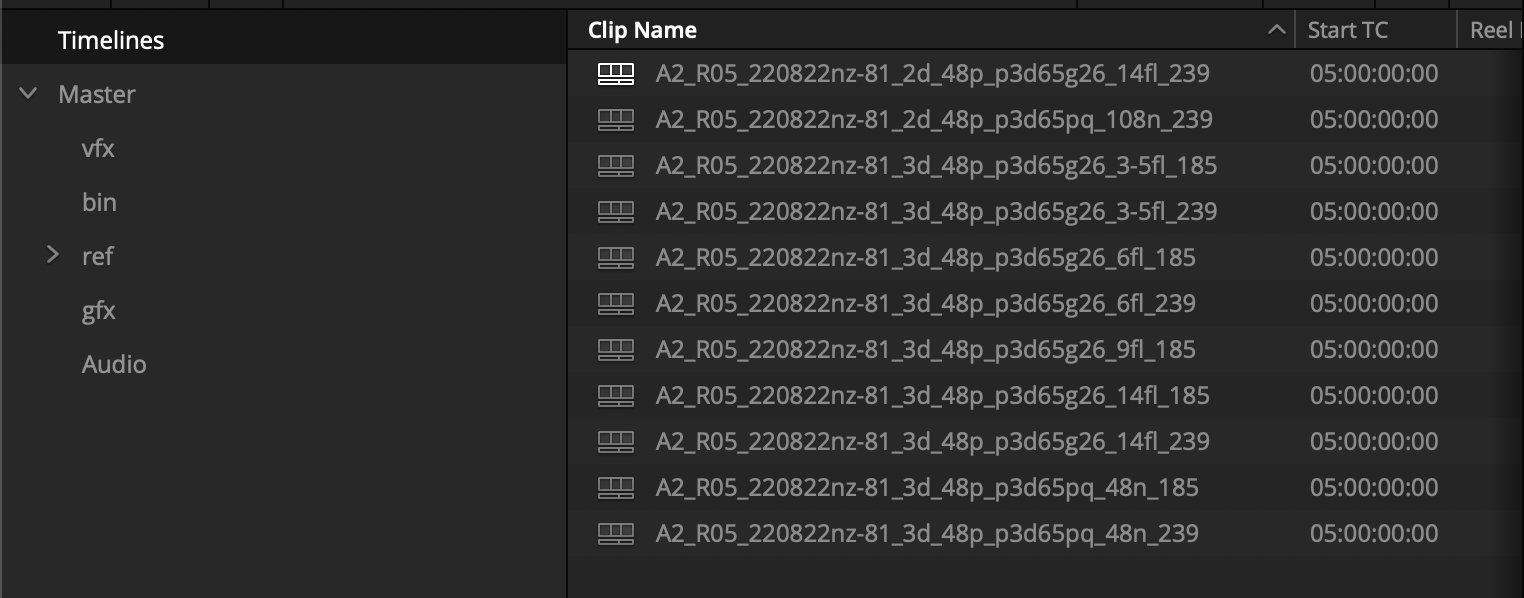

(Park Road Post公司的)蒂姆·威利斯(Tim Willis)担任主线上剪辑师。他处理来自图像剪辑的每日更新,要跟进变更,根据我们的调色进程的深入程度,每卷影片涉及的独特调色时间线从3到11条不等。

罗伯·戈登、弗朗西斯科·库巴斯、达米安·麦克唐奈、马修·威尔和乔恩·纽厄尔辅助蒂姆进行所有我们分发母版的渲染和质控,完成之后他们才会离开这栋楼。丹·贝斯特(Dan Best)和詹娜·乌德(Jenna Udy)管理着Park Road的团队——他们是大家协同工作的粘合剂。

在我们交付了影片之后,我记得丹对我说:“我本来以为会更困难。”

伊恩·彼得古德、詹姆斯·马克思和哈米什·查尔森领导着工程团队,让我们能全天候工作。保罗·哈里斯(Paul Harris)是我们的放映师。还有来自迪士尼、Deluxe和IMAX的另外二三十人,他们对于影片的分发也有非常重要的作用,还有许许多多我没有直接合作的人。

你用什么工作站作为你的主要调色设备?

- SuperMicro SuperServer服务器

- 2×英特尔至强Gold 6346处理器 3.10GHz

- 4×Nvidia A6000显卡+冷却器

- 256GB RAM

- 双32Gb ATTO第七代光纤通道HBA卡

- Rocky Linux操作系统

配备了什么共享存储系统?

我们使用的是经过精细调整的Quantum StorNext文件系统,旨在实现无缝衔接、相互协作的工作流。多个Quantum F系列NVMe存储机箱以维持每秒输入输出操作(input/output operations per second,缩写IOPS),以及一套高存储性能Quantum QXS 12G存储系统:

- Quantum F2100 NVMe阵列——双控制器/24×7.68TB NVMe固态硬盘/154TB RAID6总格式化容量/16个32Gb光纤通道端口

- Quantum QXS-484 HDD阵列——1.44PB卷RAID6格式化容量/168×LFF 7.2k硬盘

NVMe和HDD卷是分开的。我们把所有源文件都保留在一个NVMe卷上,把渲染都放到另一个上。渲染文件会经过质控,然后移至旋转磁盘存储,并上传至AWS进行编码和数字电影包制作。

所有这些,都以最新的第七代光纤通道基础设施,包括多个Brocade G720第七代FC交换机,连接在一起。

在主调光棚里使用的是什么投影仪和屏幕?

两台杜比视界科视Christie Eclipse E3LH投影仪用在了主要的调光棚里,影像投在了一面约12米宽的哈克尼斯低增益白色幕布上。

我们还有第二套杜比视界设置用于沿着走廊往前的一个较小的调光棚里,它作为备用调光和质控棚。

图源:塔希·特里尤

对于氙气灯/3.5fL的调色,你有备用投影仪吗?还是你用你的主投影仪来模拟那些?

我们有一间调色室是以Christie CP2220投影仪和一套RealD 3D系统设置的,用于进行初步测试,然后进行最终的SDR渲染质控。我们会把那间调色室跟主调光棚做对比。我们达成了一个合理的接近真实世界的对比度,通过使用杜比投影仪的DCI模拟模式,在调光棚中进行模拟。

在一个理想的世界中,我们的调光棚里还会有一个传统的氙气灯DCI投影仪,但每一个放映室都有其局限性。最终,我对我们实现的结果,以及它带给我们的工作流灵活性感到非常满意。能在调光棚里,在不用移动房间、系统、路由和处理那些麻烦事的情况下,能在30-60秒内切换为任意格式,真的是很奢侈的事情。我们在调光棚里所看到的效果,准确地反映了商用DCI投影仪和IMAX激光投影以及氙气灯投影的现实体验。

你使用的是什么调色软件?

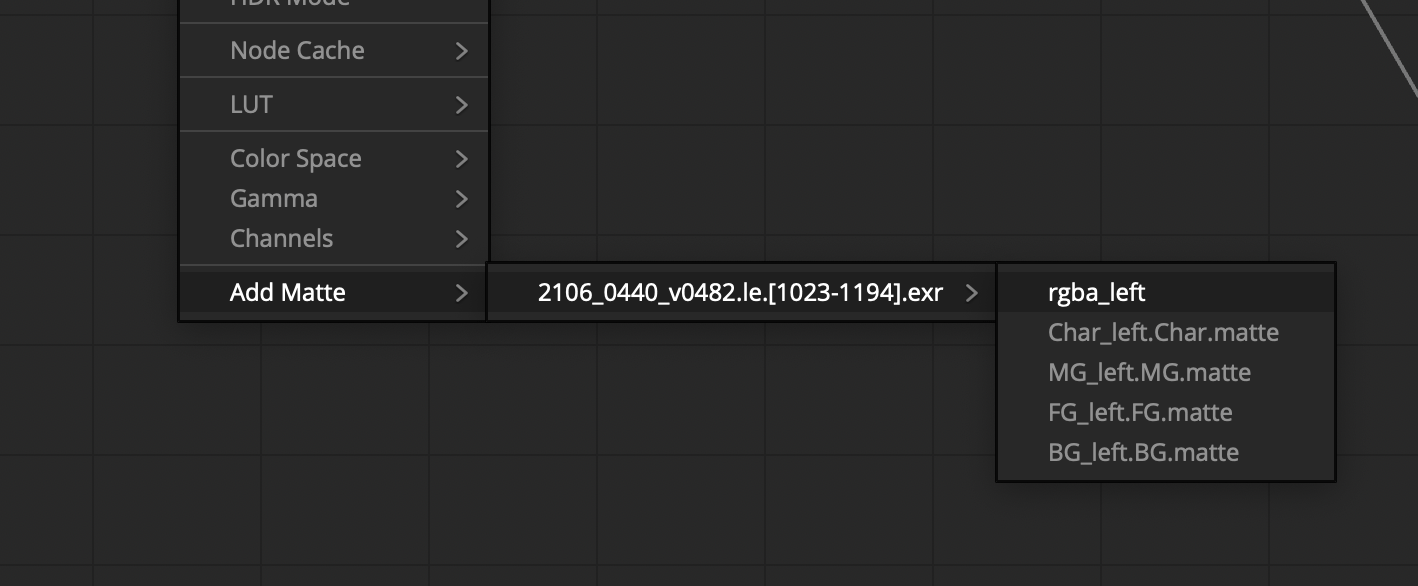

项目刚开始是达芬奇17,到后来变成了达芬奇18.0.2。对于我不想直接在达芬奇里处理光学效果的情况,还用到了NukeX。

你的示波器设置是怎样的?

我用了Time in Pixels的托马什·胡切克(Tomasz Huczek)开创的Nobe OmniScope,搭配Blackmagic Design的Decklink 8K Pro采集卡在HP Z840工作站上运行,这样它就能处理47.952p的信号格式。市面上有许多硬件示波器解决方案。但我喜欢这个基于软件的解决方案,因为它真的非常模块化,很容易配置,并且一直在优化。

我在顶部的另一个窗口运行着一个Python脚本,它会探询我的达芬奇获取当前片段名称,这样罗比和我在做视效版本检查的时候就很容易看到它。目前,还没有什么好办法可以在调色页方便地看到完整的片段名称。回想起来,这算是那种很难离得开的提升生活质量的小东西之一。

图源:塔希·特里尤

不同公司之间使用的是什么网络或暗光纤连接?从新西兰到美国之间用的是什么?

我们用的是Park Road在Park Road后期公司和维塔数码之间的私有暗光纤基础设施,以及自动化的同步脚本——一旦一切素材在维塔数码可用,我们就能获取到。

即便我们在美国,同时交付11个数字电影发行母版(DCDM)也是很吓人的。

Park Road的伊恩·比德古德(Ian Bidgood)想到个绝妙的点子,即舍弃传统的16-bit TIFF DCDM办法,转而直接从达芬奇渲染无损压缩的JPEG2000,这为我们节省了多达50%的大小和带宽要求。迪士尼、Deluxe和IMAX全都这么做,并且效果很好。

我们把各个DCDM交付给AWS,迪士尼的THANOS(院线自动网络运行系统)小组就会在上面收集文件,并开始将它们处理成许多不同的DCP版本。我们使用了私有Sohonet连接、AWS FastLane和两个10gbps连接,直接连到澳大利亚悉尼的AWS S3存储单元。迪士尼随后就可以利用AWS主干网从悉尼同步给美国那边。

在开始处理《阿凡达:水之道》之前,为了在续集前重映原版,你给《阿凡达》做了4K 48fps立体3D重制。那个流程是怎样的?

《阿凡达》(2009)的重制需要回头去找2009年原版院线上映和2010年特别版重映的原始工程文件。那些项目都是在达芬奇6里创建的。Blackmagic Design的达维恩·麦加特(Dwaine Maggart)为我们在他们伯班克的办公室搭建了一套系统,我们在那重新应用了旧的项目数据库,并把项目带到更新版本中。达芬奇在处理立体时间线方面有一些结构性变动,我当时担心系统会崩溃,导致我们只能使用真的很老的版本,但我们奇迹般地成功把项目升级到了最新版,并持续升级,直至我在过去的一年在达芬奇18里完成了重制。

所有的真人元素和大部分的原始视效都为了这次重制进行了1920×1080母版制作,我们想把像素扩增到4K。在前几年,那是不现实的,而且大部分扩增像素的算法本质上都是以一定程度的锐化来进行调整,并不会增加太多价值。

我们使用了Park Road Post的专利的扩增像素步骤,那是他们为了自己的《他们已不再变老》(They Shall Not Grow Old)和《披头士乐队:回归》(The Beatles: Get Back)的工作而开发的。

使用SGO的Mistika调色系统,一位像素扩增艺术家首先要为像素扩增进行镜头分析,并且,依据镜头特性,会使用几种不同的滤镜来处理噪点或颗粒,确保不会损失任何图像质量。他们的专利管线使用了机器学习(ML)来提高分辨率。他们甚至可以给镜头的局部进行转描,然后把机器学习过程的不同等级混合回去,以输出最终镜头。最终,这不单单是一个自动化的过程,还是一个由艺术家来组织的处理方式,它可以提供优于商业性的现成解决方案的巨大优势。

技术工作流与交付文件

你所交付的这11个不同的院线版本是什么技术规格?

➔ DolbyVision 3D 14fL 48fps 1.85

➔ DolbyVision 3D 14fL 48fps 2.39

➔ DolbyVision 2D 31.5fL 48fps 2.39

➔ IMAX 3D 9fL 48fps 1.85

➔ Digital Cinema 2D 14fL 48fps 2.39

➔ Digital Cinema 3D 14fL 48fps 1.85

➔ Digital Cinema 3D 14fL 48fps 2.39

➔ Digital Cinema 3D 6fL 48fps 1.85

➔ Digital Cinema 3D 6fL 48fps 2.39

➔ Digital Cinema 3D 3.5fL 48fps 1.85

➔ Digital Cinema 3D 3.5fL 48fps 2.39

杜比影院激光投影仪具有很高的光输出和杰出的立体分离表现,杜比视界3D版是你的主调色吗?

是的。杜比影院是目前我最喜欢的格式。相较于其他格式,它的妥协更少。但没有什么是完美的。相较于线性或圆形偏振片,杜比的偏振片更小,视场也稍微更小,而如果你稍微转转头,它会在边缘轻微染色。但线性偏振片完全不会让你仰头,并且无论是线性还是圆形偏振系统,都没有像杜比的波长分离技术那么好的相消效果。窄谱激光并不*理想*,而且就像OLED一样,可能会导致对某些人产生一些同色异谱挑战(想进一步了解“同色异谱”,可阅读这篇文章:《什么是同色异谱?》)但其亮度等级远比氙气灯要好,而且3D绝对更出色和无瑕疵。

为什么选达芬奇作为调色平台?

我有多年的达芬奇调色和剪辑丰富经验。我对它的优缺点了如指掌。达芬奇最近的数据库性能提升使得简单的保存/加载操作比此前的项目更快捷。我们一开始用的是达芬奇17,在制作过程中升级到18,因为我想充分利用18当中大型项目数据库的优化功能。最终我们是在18.0.2版里进行了完成片制作。现在,我们可以在单个项目中保持多条时间线而不会有太多系统开销。派生调色之间的版本管理与维护简单多了,所需的DI剪辑媒体管理和手动操作要少得多。

我们充分利用了达芬奇的Python API,而我写了几个脚本来加速我们的镜头获取和版本检查,如此一来,镜头一准备好,我们就可以快速应用素材更新。这对于一部含有大量视效的电影至关重要,尤其是这部片几乎每个镜头都是视效,并要相应进行跟踪。我写了脚本来自动从EDL加载镜头,对比当前EDL和文件系统上的新镜头,并为快速更换剪辑和镜头更新生成不同的EDL。

每天新的素材和镜头交付过来的时候,你和你助理的工作过程是怎样的?

由第一助理剪辑师贾斯汀·耶茨(Justin Yates)和本·墨菲(Ben Murphy)领导的图像剪辑组会把素材交接给我们的线上剪辑师蒂姆·威利斯。他会为每个母版格式在之前版本的不同时间线上铺上所有新的、更新的镜头。在那个基础上,我会手动复制我之前的调色,然后肉眼比较更新版本的区别,看看哪里可能需要更改调色。

为了在终版之前能快速且前后匹配地审查镜头,可以制作经批准的剪辑交接,我们用了一些我的达芬奇Python API脚本,只为新镜头生成更新的EDL。

你在前期制作中发挥什么作用?成片图像有多匹配pre-viz和预期的风格?

我并没有大量参与前期制作。早些时候我与(DP)拉塞尔·卡朋特(Russell Carpenter)进行了一些摄影机测试,看到了他拍的一些很精彩、很细节的测试,主要是立体拍摄。

我记得的一个主要测试是对比不同的色板样品的偏振特性。立体摄影的一个大挑战在于,要消除不同摄影机取景孔之间的光学差异。偏振光可以通过分光镜进入一只眼睛时被过滤掉,但会被反射到另一只眼里。那会导致相当令人不适的不匹配现象,进而产生“糟糕的3D”。我印象很深刻的是,拉塞尔及其团队如此努力来完善他们的处理方式,并反馈给美术设计。正是那种水平的准备在很大程度上成就了这部电影完美的立体3D。

这部电影的虚拟制作过程超出了任何个人可以解释的程度。

每当我以为自己已经对它有了全面的了解时,总会了解到一些让我震惊的新东西。其他对虚拟制作更有权威的人可以更详细地解释那些。但我知道阿詹一直是一丝不苟的,无论是对自己真人和虚拟拍摄的掌机,在镜头模板阶段的布光,还是成片的布光。其创意意图贯穿始终,但那些模板对DI的帮助并不是特别大,也就是充当一些虚拟占位符。我大致上只为成片或成片备选素材调色。

从维塔数码接收镜头并进行镜头套底的流程是怎样的?

这个项目的首席技术官蒂姆·比丘(Tim Bicio)编写了Framebot,这是一个专利系统,通过他们安全的ECS S3私有云,用于交换和同步视效镜头。随着维塔交付视效审片议程,那些镜头会自动被下载到我们在Park Road Post的本地SAN,让我们能即时访问。这节省了很多时间,并且还规避了传统的EDL顺片,略去了镜头搜索和时常发生的镜头请求过程。

将视效镜头维持在云存储中,就能让视效制作团队、合作的视效公司、剪辑以及后期制作完成片人员按需进行访问。影片完成并交付后,S3存储单元就直接变成了我们的存档空间,并不需要像常规LTO存档那样的费力,也不用验证。

因为我们是在Park Road的放映厅进行立体审片的,那意味着,我们马上可以使用最新、最好的镜头。只要视效剪辑一确认版本,并提供图像交接,我们就能完成版本同步。

你从维塔数码收到的片段是什么格式?用的什么数据率?他们有内嵌蒙版吗?

这部片的所有视效都以带内嵌蒙版的OpenEXR交付,通常是前景、背景、中景和CGI角色蒙版,取决于合成的复杂程度。

图源:塔希·特里尤

RGB图层是未压缩的,以优化回放表现,而蒙版是ZIP压缩的。

你为什么以卷来工作,而不是采用单一的长时间播放的时间线?

制片厂的长片一贯以卷来处理,不用长时间线。那样剪辑起来更简单,也方便在所有部门中进行工作的分发和并行。我想混音部门也很喜欢这一点,因为他们是将多个Pro Tools系统链到一起的,并且混音级(mix stage)上的系统开销和管理强度更大。

这部片拆成了15卷,每一卷时长仅有10-15分钟,这是为了方便更短时间的审片。既定时间内只用关注少数几个场景,就更容易跟导演约时间。

每一卷都有各自的工程文件,每个都包含了多达11个各格式、亮度等级和宽高比的不同院线母版。

以这种方式工作可以更简单地让我在Park Road Post的DI剪辑师蒂姆·威利斯快速应用变化剪辑,而我可以在版本之间快速应用创意色彩更新。

图源:塔希·特里尤

调色过程中在达芬奇里维持实时回放有没有什么挑战?

就算是最先进的工作站和存储基础设施,(回放)48fps 3D都是挑战。基于NVMe的SAN速度达6GB/s,而我们几乎不受影响,就算当其他系统在访问存储卷获取渲染文件时也不影响。

转场和暂时的Resolve FX一般需要为实时回放进行缓存。我偶尔会用Deflicker在噪点较多的镜头中减少振动,或者去除罕见的立体伪影(那也需要缓存)。

调色期间你的立体工作流是怎样的?

立体3D是这部电影的重中之重,因为所有真人摄影都采用了3D原生拍摄,而所有视效镜头都以3D原生制作。从第一天开始,我们就通过3D眼镜给每边眼睛以3D杜比视界在48尼特(或相当于14fL)的亮度下进行调色和审片。

图源:20th Century Studios

许多电影不到制作流程的末尾是享受不到杜比调色的,所以他们可能一开始是2D主调色,最终当足够的素材被锁定并转成3D后才能得到3D版本。那么,给较低的亮度等级调色时,他们就无法对立体方面的问题或决策获得相同的可视度。

我们很幸运,一开始就以杜比视界3D 48尼特调色,然后再一步步处理较低的亮度等级,所以我们从一开始就能看到很敞亮的一切。

那给予我们更多时间来进行立体决策,比如获取经过动画处理的镜头覆盖,或者要求视效再进行额外的处理,以增强立体效果。

你们是从一开始就以高帧率48fps工作的吗?

我们从第一天就是以48fps调色。看到各个48fps和24fps镜头如何搭配起来是关键,并且因为我们所有的24fps交付文件都可以通过B帧丢帧的方式从48fps中获取,我们很容易就依赖48fps作为主母版。

我们的达芬奇项目全都配置为了23.976,但我们的各个时间线设置为了47.952。这么做是方便从图像剪辑(他们以23.976操作)得到的EDL套底。达芬奇处理混合帧率的能力相当不错,所以,一旦47.952的片段以23.976套底,很容易就能将它们复制粘贴进一条47.952的时间线,并能精确地构图,显露B帧。

你认为以无损JPEG2000作为DCDM的选择,会不会成为以后项目的一种可行替代方案?

没什么理由不用它。几乎我所制作的每一个项目都购置了额外的R’G’B’存档元素,这样DCDM可能就不再只是长期的存档工作元素,而是作为未来重制的参考,变得更有用。有一个优势是,DCDM是X’Y’Z’色彩空间,并且不要求特定渲染设备,但我觉得,我们的存档标记做得足够好,足以在未来几十年依旧可以判读P3D65 R’G’B’。

在我的测试里,16-Bit的JPEG2000相较于16-bit TIFF并没有显示质量损失。12-bit会有,但很小。考虑到最终的DCP会被压缩为250-400mb/s,对于在12-bit无损压缩才能稍稍衡量出来的差异,我感觉相当满意了。我们这里讨论的错误是低于0.01%的平均误差。而我们获得的交付速度是很值当的。

出处:Peder Morgenthaler | Mixing Light

翻译:LorianneW | 盖雅翻译小组

-300x152.x33687.jpg)