在开始分享前:免责声明

本文的HDR视频只有在使用支持HDR的显示设备上观看/阅读时才可看到HDR效果(若使用移动端查看,手机须支持HDR,并能让你从YouTube的APP调整HDR设置。)。我还会在文中附上两种格式的SDR质量的图像,即便你使用SDR来观看,也便于你理解HDR。祝你阅读愉快,愿列奥纳多·达·芬奇(Leonardo Davinci)与你同在。

调色师菲利波·奇诺蒂(Filippo Cinotti)

图源:Scuola Spaziotempo

现在……我们来想象一下这种章回体开头就像是下面这个家伙创作的:

第一章:“多姿多彩的HDR世界”

我们看到一个特写——一只手在一台调色监视器上调来调去,调节一个HDR图像的亮度和对比度。随着图像变化,屏幕闪烁,揭示出了一个令人惊艳的自然风光镜头,色彩艳丽,细节清晰。

摄影机拉远,看到暗室中的一个身影,专心致志地躬身坐在监视器前。这就是我们的主角,一位热爱HDR的资深调色师。他已经为这个项目调色好几周了,尽心尽力将每个镜头微调到完美状态。

镜头切到一组蒙太奇……兄弟,你说谁资深?我?不不不……让我们切到重点。

让我来给大家解释解释……

朋友们、关注者们,大家好,我是菲利波·奇诺蒂,又来给大家开一篇新文章啦。

这一次,我想聊的这个东西,大概快10年前就存在了(我指的是第一批消费级HDR电视那时候推出),但对某些专业人士(这里不只指代调色师)比如我来说,这个东西仍然不是日常的特定要求输出。

可能你从文章标题就看出来了,我要讲的是HDR(高动态范围)。

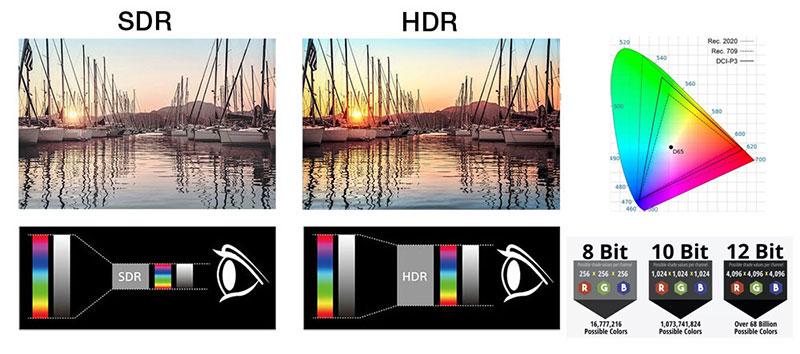

HDR指的是高动态范围(High Dynamic Range),平面摄影与视频摄影运用这种技术采集和显示比传统技术更广的亮度和色彩范围。HDR图像和SDR图像(标准动态范围-Standard Dynamic Range)的主要区别在于图像最亮与最暗区域能显示的细节、色彩和亮度范围。

一个HDR图像可以采集比SDR图像更大的亮度范围,那意味着,HDR可以显示出更多图像阴影与高光细节。这就会形成更逼真和鲜艳的图像,有更多对比度和深度。

很值得反思和记住HDR摄影问世的早期阶段,那时候大家会把文件数据调到很不现实的状态,纯粹是……因为他们可以那么做。

还有几点要专门提一下,在视觉上(和技术上),HDR和SDR图像有几个关键差异。以下是最重要的几点差异:

1:亮度

HDR图像可以显示比SDR图像亮得多的高光和暗得多的阴影。这意味着,HDR图像在图像最亮和最暗区域都有更多细节。

基础性HDR交付的尼特数和其他数值会根据所使用的特定HDR标准而有所不同。

对于HDR10这个最常用的HDR标准,最低亮度要求是1000尼特。

这意味着,显示设备必须能够达到至少1000尼特亮度才能完全显示出HDR内容。

如果要聊特定标准,那亮度值的变化更大。

对于杜比视界这种更高级的HDR标准,所要求的峰值亮度范围是1000尼特到10000尼特,取决于内容。此外,杜比视界比HDR10支持的色域更广,位深更高,这能得到更准确和更鲜艳的颜色,以及更细致的亮度渐变。

在流媒体的HDR标准方面,Netflix和Amazon Prime Video都有自己的HDR内容要求。对于Netflix,HDR内容要求的最低峰值亮度是1000尼特,色彩空间必须至少为Rec.709或DCI-P3。此外,Netflix还推荐使用至少10-bit位深(他们一直在更新各种摄影机的标准)。

对于Amazon Prime Video,HDR内容的要求差不多,最低峰值亮度为1000尼特,色彩空间至少是Rec.709或DCI-P3。但是,Amazon Prime Video除了支持HDR10和杜比视界,还支持HDR10+,这能提供更多动态范围和色彩深度。

2:对比度

HDR图像对比度比SDR图像高得多,图像最亮与最暗区域之间的差异更显著。这就使得图像看起来更鲜艳、更逼真。并且,对比度是HDR成像的一个至关重要的方面,因为它可以显示出更细致的细节和更微妙的亮度渐变。HDR的对比度值参数会根据所使用的特定标准而变化。

对于HDR10这个大部分流媒体和蓝光碟使用的基础HDR标准,它要求的最低对比度是10,000:1。这意味着,图像最亮的部分必须至少比图像最暗部分亮10000倍。

对于杜比视界,对比度参数更为复杂,并且会根据所交付的特定内容变化。杜比视界支持动态元数据,它能让内容根据显示设备的特定性能进行优化。动态元数据可以逐场景地调节内容的亮度和对比度值,对图像质量有更精确的控制。一般来说,杜比视界要求的对比度比HDR10高,杜比视界的目标对比度高达1,000,000:1。

对于Netflix和Amazon Prime Video,他们的对比度参数类似HDR10,最低对比度为10,000:1。但是,这两家流媒体还支持HDR10+和杜比视界,这就能比只支持HDR10提供更多动态元数据和更高对比度。

值得注意的是,对比度只是HDR成像其中一个方面,色彩空间、尼特值和位深等其他因素也对HDR图像的整体质量有重要作用。此外,虽然这些对比度和其他参数对创建和交付HDR内容提供了有用框架,但实际的图像质量还取决于各种因素,比如源素材的质量,显示设备的性能,和观看者个人的感知。

3:色彩(和色彩空间)

HDR图像可以显示比SDR图像范围更广的色彩,生成更准确而鲜艳的色彩。色彩空间是HDR成像另一个重要方面,它定义了图像中可以显示的色彩范围。交付HDR所要求的基础色彩空间一般比标准动态范围(SDR)内容的色彩空间更广,以此支持HDR所提供的扩展的色彩范围。

HDR最常用的色彩空间是Rec.2020,它比SDR内容使用的Rec.709色彩范围更广。Rec.2020比Rec.709覆盖的可见光谱更多,并且支持更广范围的色彩亮度和饱和度。

但是,并非所有显示设备都能完全重现Rec.2020色彩空间,有的HDR内容可能会以其他色彩空间交付,比如DCI-P3,这是常用于影院的色彩空间。

对于Netflix,HDR内容色彩空间的最低要求是Rec.709或DCI-P3,推荐使用的色彩空间是Rec.2020。Netflix还支持BT.2100色彩空间,这是一个更近期的标准,它扩展了可以显示的色彩范围。

对于Amazon Prime Video,HDR内容色彩空间的最低要求是Rec.709或DCI-P3,推荐使用的色彩空间是Rec.2020。Amazon Prime Video也支持BT.2100色彩空间,这是一个更近期的标准,它扩展了可以显示的色彩范围。

对于杜比视界,色彩空间要求会根据所交付的特定内容变化。杜比视界比其他HDR标准支持的色彩范围更广,包括Rec.2020、P3-D65和BT.2100。

用于特定内容的特定色彩空间取决于多种因素,比如制作流程,目标设备的显示性能,以及符合意图的艺术构想。

4:细节

HDR其中一个关键优势就是它能在图像最亮和最暗部分显示更多细节。这是通过使用更广的动态范围实现的,动态范围更广就能有更细致的亮度和对比度渐变。

众所周知,SDR内容的最高亮度通常上限大约在100尼特,而HDR内容的最高亮度高得多,经常超过1000尼特,有些情况下甚至更高。更高的亮度水平可以带来更自然和沉浸式的观看体验,高光和阴影有更多层次和细节。

除了亮度的提升,HDR内容一般还会使用比SDR内容更高的位深。SDR内容通常以每色彩通道8-bit来编码,但HDR内容一般以每色彩通道10-bit或更高来编码,可能实现的色彩和色调范围更广。

HDR内容更高的亮度和位深还会对用于观看内容的显示技术产生影响……话虽如此,HDR内容交付的挑战之一是要确保内容会为性能不同的各种显示设备进行优化。动态元数据这就有用武之地了,它能让内容根据显示设备的特定性能逐场景优化。这有助于确保内容按照创作意图显示出来,在各个显示设备上都能看到最多细节跟微妙差别。

HDR内容拥有的更多细节和细微差别,可以提供更有沉浸感和代入感的观看体验。但是,为了充分利用HDR扩展的动态范围和色彩空间,显示设备需要能够重现更广范围的亮度和色彩值,并且内容需要为性能不同的各种显示设备进行优化。

因为HDR图像可以在图像最亮和最暗区域采集更多信息,所以它们可以显示出在SDR图像中可能丢失的更细微的细节。

……现在我们知道,为了实现HDR,采集图像的摄影机需要比传统摄影机拥有更高的动态范围(我猜几年后任何一台摄影机都会有HDR性能,但仍然得不少于10-bit),使用包围曝光这样的技术,并合并多重曝光。

此外,用于观看HDR图像的显示技术必须还要能够显示出范围更广的亮度和色彩。这可以通过使用更高亮度水平、更广色域和更准确的色彩重现来实现。

色彩空间、IRE水平和尼特都是HDR成像的重要因素。色彩空间是指可以被显示的色彩范围,而HDR一般使用更广色域,如Rec.2020,它能显示的色彩范围比Rec.709这样的SDR色彩空间广得多。

IRE水平是指视频所使用的信号level,一般HDR使用的IRE范围比SDR更高,这能在图像最亮区域得到更多细节。

最后,尼特指的是显示设备的亮度水平,HDR显示设备一般会达到比SDR显示设备更高的尼特值,得到图像中更亮的高光。

总的来说,相较于SDR图像,HDR图像提供的是更为逼真和生动的观看体验,亮度更高,对比度更高,色彩更鲜艳,细节更多。实现HDR需要专门的设备和显示技术,包括具有更高动态范围的摄影机,具有广色域的显示设备,更高的尼特值,等等。

到现在,你们应该猜到了,要来谈谈我个人的HDR经验了。

第二章:高动态范围YouTube案例:(暂译)《深海》(The Iron Sea)

让我来告诉大家:跟你们大部分人一样,我并不是全职做HDR项目调色的。

目前我客户的需求并不是专门做HDR项目,所以说,如果项目不是长片电影或纪录片,我可以说,多数情况下客户不会要求HDR调色。

正是因此,就凭我这一丁点HDR专业技能,当我有这个机会给HDR影片调色时,我真的心动不已。

为什么呢?以下是我的三大实用性理由:

•从黑暗的角落到活灵活现的高光里的微小细节,你真的可以看出图像反馈给你的效果

•光度响应真正让你对场景身临其境(对于高调布光的镜头,会想戴上墨镜看)

•你在后期制作中所拥有的可能性真正得到扩展(HDR还给了你把画面调得一团糟的可能性)

既然聊到这个特定的情况,我将谈一谈为YouTube的HDR影片调色——包括你可能会遇到的没那么有实操性也没那么有趣的事情,并谈一谈HDR交付。(到文章结尾你就知道为什么了)

首先我想跟大家说的是,我很荣幸为这支短片进行HDR调色,这支短片来自Media Division鼎鼎大名的这集:(暂译)《不可能的镜头》(The Impossible Lens)

为摄影机和这款不可能的镜头做测试,并真正充分利用它们,对我来说是很有意思的体验,尽管这里采用HDR调色本就是为了真正看到水池镜头和开头几个镜头的所有细节。

对了,如果有人想看,这是这支HDR短片的链接:

https://www.youtube.com/watch?v=4upX2OGsfbY

图源:Media Division

至于调色流程本身,跟传统的SDR调色很不一样。

第三章:不适用于YouTube的HDR调色与交付流程

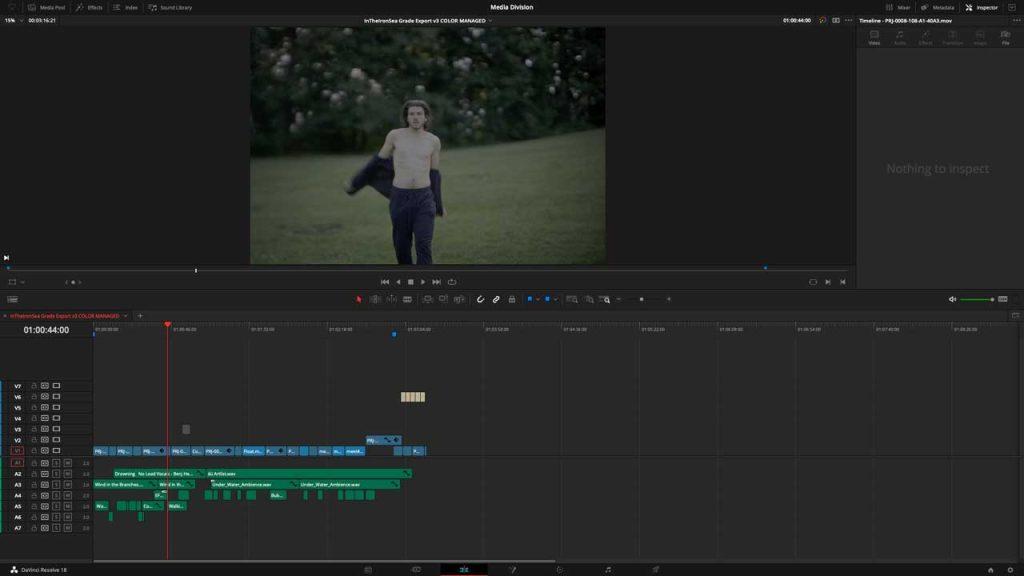

如果你认识我有一段时间了,你可能知道,我是一名使用达芬奇的调色师(我一般不使用Baselight或其他任何软件),所以对于这个项目我也是用达芬奇作为起始点。

所以我的做第一步是打开我的时间线,观看剪辑,看看尼古拉斯(Media Division的首席执行官兼创始人尼古拉斯·莫尔登豪尔-Nikolas Moldenhauer)在达芬奇里做的微调。

我们都知道他不是一名调色师,所以我就看到了想必会看到的东西:一版调色,基于他有的每一段剪辑片段的自定义结构……我需要去掉那版调色并从头开始。

于是我做了我会建议任何处于这种情况的人要做的事:我复制了时间线,通过将我的片段按三大主要情况分组设置了整个工作流,:

这是一个小项目,里面有23个剪辑片段,我觉得更实用的方式是:把森林的基础片段分到‘片段’组;把湖的片段分到‘外景’组;把昏暗的片段分到‘池子’组。

话虽如此,我已经准备好重新构思我的固定节点结构了,我会在时间线中保持尼古拉斯做的调色,但会把它关闭。我觉得他那版调色说不定什么时候会有用,所以我决定不删掉他调的一切。

基于我最常用的工作流,我决定将工作流分为3大组。

这是我为这种项目调色最常用的方法,我还可以在这条管线结尾添加一个色彩空间转换。为什么?是为了将所使用的色彩空间转码并重新形成另一个色彩空间用于一个不同的导出。

(这个过程被称为“pass”,但话说我并没有在这个项目的调色中这么做,因为这个项目本来就是只发布HDR版……但想象一下,通过添加一个节点并恢复/映射数据,我们就可以想怎么调就怎么调)。

这个过程是参照显示设备(Display Referred)的(由我在这个结构中处理色彩管理)。

所以我是这么设置的:

片段前群组:Kinenfinity转码为Arri LogC色彩空间(为了让片段转为Arri LogC——马上就知道为什么了)。我在这用的是Look Designer插件而不是色彩空间转换。

片段群组:这只不过是一个进行曝光和白平衡微调的基础校色节点。我在需要的时候加了几个并行节点——但主要还是微调曝光和几个白平衡小修复(嘿,谁让素材拍得好呢——可不怪我)

片段后群组:有意思的地方来了。在第一个校色节点上,我套上了为尼古拉斯生成的ShowLUT(如果你想的话,可以把这个叫做风格节点),我在这用Look Designer将我仍需处理的Kodak 5219负片放到了一个Arri的色彩空间里。第二个校色节点上,我还是用Look Designer,输入Arri,输出Rec 709 2.4(最初是在一台2.4的显示设备上做第一版调色)。如果我进行SDR交付,那么至此调色链条终止……而现在我们需要扩展这些工作流。

这时候就要处理HDR了,所以请仔细读:

这时候我把我的监视器切换为HDR P3-D65 St2084(1000尼特)进行HDR调色。再次说明:至此,如果你的监视器无法处理这种色彩空间,那么你就无法进行HDR调色。

把这句再读一遍:如果你的监视器无法处理这种色彩空间,那么你就无法进行HDR调色。

这是由一系列3个校色串行节点(高光/暗部恢复与映射节点)结合我最后的709色彩空间转HDR P3-D65 ST2084节点组成的。

这么一来,搭配一台设置妥善的监视器,我现在就可以处理HDR调色,给我的片段完整的风格,最终完成项目,并准备好可以用正确的元数据导出我的时间线……直到(我出现了如下表情)

如果从技术层面来说,一切显示都正确,并且在实际层面,一切看起来很棒,但YouTube就是不把视频认成HDR,还是把它当一条SDR时间线。

在研究了一番之后(是的,本来应该在第二章就做功课了,但嘿,我是个人,会犯错),我发现是这样:

基本上(根据YouTube指南):

如果你给视频调色,要以Rec.2020搭配PQ或HLG调色。用不同配置的话,包括DCI P3,会得到不正确的结果。

一旦视频正确打上HDR标签,你只需遵循常规视频上传流程上传视频。YouTube会侦测HDR元数据并处理它,为HDR设备生成HDR转码,为其他设备进行SDR下转换。

我把配置搞砸了……需要把项目带回正轨。

在我再次投入处理流程前,我想给大家更多的指引:

分辨率 | 720p、1080p、1440p、2160p |

|---|---|

为得到最佳效果,使用UHD宽度,别用DCI宽度(比如,用3840×1600,别用4096×1716)。 | |

帧率 | 23.976、24、25、29.97、30、48、50、59.94、60 |

色彩深度 | 10 bits或12 bits |

色彩原色 | Rec.2020 |

色彩矩阵 | Rec.2020非恒定亮度 |

EOTF | PQ或HLG(Rec.2100) |

视频比特率 | 对于H.264,使用推荐的上传编码设置 |

音频 | 与推荐的上传编码设置相同 |

HDR视频文件编码

这些封装格式经测试有效:

•MOV/QuickTime

•MP4

•MKV

推荐这些编解码器,因为它们支持HDR元数据10-bit编码,并能以合理的比特率交付高品质视频

•VP9 Profile 2

•AV1

•HEVC/H.265

这些编解码器也能用,但需要非常高的比特率才能实现高质量,这可能会导致更长的上传和处理时间:

•ProRes 422

•ProRes 4444

•DNxHR HQX

•H.264 10-bit

HDR元数据

为了被妥善处理,HDR视频必须在加标签时有正确的:

•转换函数(PQ或HLG)

•色彩原色(Rec2020)

•矩阵(Rec.2020非恒定亮度)

HDR视频使用PQ传递信号应该还包含关于制作母版所使用的显示设备的信息(SMPTE ST 2086母版制作元数据)。它还应该有亮度细节(CEA 861-3 MaxFALL和MaxCLL)。如果缺少这些,我们就用1000尼特HDR母版显示设备的值。

另一种情况是,HDR视频可能包含动态(HDR10+)元数据,体现为ITU-T T.35终端标识码或SEI头信息。

HDR创作工具

以下是将HDR视频上传YouTube可用的工具示例:

•DaVinci Resolve

•Adobe Premiere Pro

•Adobe After Effects

•Final Cut Pro X

第四章:适用于YouTube的HDR调色与交付流程

第一步,我先把项目的一切设置正确(并决定这一次我要在色彩管理的状态下工作)。于是我打开了项目设置,然后这么来设置:

搞笑的是,我在旧版本上做过这个微调,但旧版本还是不能被YouTube处理。

分组前群组:跟之前一样,Kino转LogC,只是加上了用于整个分组前的整体偏移,并把LookDesigner的风格处理烧入这里,而不同的地方在于,我在这以LogC输出,不以Rec709 2.4输出。

所有这些……都在不到48小时完成,还有一次尼古拉斯的审片。

第五章:上线YouTube

我对YouTube方面的第一个考虑是,对于这样的一个项目,你要考虑最重要的东西:时间。

YouTube需要花大概2-3天来处理你的HDR图像,到处理完成前,视频都只会看起来是失败的SDR上传。

而你知道吗?就算这些项目设置都正确,YouTube并不会数到3就随机处理两版上传。可能最初的工作流也能行?谁知道呢。

我现在知道的是,当时一天天等待每一次上传得到处理让人痛苦万分,因为我不知道是不是自己遗漏了什么,还是只是……我最亲爱的YouTube编码器的问题。

希望你们的下一次导出不会像我的那么痛苦。

但得到的结果让花在这个项目上的每一分钟都值了。

送上我最好的祝福。

—— 菲利波

出处:Filippo Cinotti | Plasma Republic

翻译:LorianneW | 盖雅翻译小组

-300x152.x33687.jpg)