本文中,我会告诉大家 Live FX 堪称视频回放(当然包括行车场景)最强媒体服务器的25个原因。我一开始只列出了3个原因,随后的每一周,我持续添加新的原因,我认为当前总结的25点是个不错的开始,我们可以一起看看最终我能总结出多少个原因。

如果你要去参加拉斯维加斯的 NAB 展,可以到 The Studio-B&H的N2427 展位看看,我们很乐意当面为大家展示 Live FX 的所有这些功能!

这是一篇长文,而且我可能之后还会进行拓展,但如果你没时间读完,我现在就能给你一个最短的解释:

Live FX 专为高端色彩完成片制作、实时合成与实时回放而设计,而其他的媒体服务器是服务于现场活动而创造的。

(有了 Live FX )只需一台 Silverdraft 服务器,你就能驱动多达7个 4K HDR LED 处理器,播放多个 12K 360视频流,利用遮罩进行实时调色,对视频实时应用克隆图章功能(clone stamp),根据回放内容映射数百个灯具,同时还可以进行实时网格变形。

我觉得我需要重申,以上所有这些是可以同时实现的,只需要一个软件许可就能做到!

所以,Live FX 不仅比其他现场活动媒体服务器的功能强大得多,它还更划算,并且运行/维护它所需的IT基础设施更少。

你还可以把 Live FX 用于绿幕为输入的视频信号做抠像处理,输出4路信号来完成高级 GhostFrame 工作流。同样,这也是以一台电脑和一个软件许可就能实现的。

希望大家读到这里已经被这款软件所惊艳,或者感到不安,但无论如何,下面将给大家说明更多细节!

背景信息

主流的媒体服务器有诸多相同的性能,它们都可以回放素材,还可以进行基础的色彩转换等等。所以我主要会聚焦一些我认为让 Live FX 脱颖而出的独特性能。

所有其他媒体服务器都是为现场活动而创造的,所以我把它们叫做现场活动媒体服务器。而 Assimilate 深耕电影的现场和后期领域,所以我将其称为唯一的电影级媒体服务器。确实,它具备了各种必要工具,是唯一一款可以妥善处理高端电影、电视和广告项目以及广义上的虚拟制作媒体回放的媒体服务器。

我实操过所有主流媒体服务器。那些服务器我都试用过,正是出于实操经验我才会说,Live FX 独树一帜、出类拔萃。其他现场活动媒体服务器跟 Live FX 的功能比起来相去甚远,尤其是对于行车场景的虚拟制作处理。

有许多功能是 Live FX 独有而其他媒体服务器没有且永远不会有的,因为那些软件完全是为其他用途而打造的。

但那并不是说 Live FX 就是“万用灵药”,肯定有至少一些原因会导致你可能继续使用你的现场活动服务器,因为它们有 Live FX 尚不具备的特定功能。

但是,我知道对于大部分虚拟影棚,Live FX 是一种更优的工具,而我唯一感兴趣的是帮助虚拟制作行业中的行车场景拍摄更上一层楼。

换言之,如果你有一个 LED 虚拟影棚,并且你正在考虑使用 Live FX,那么至少有25个你应该用它的原因!

行叭,话已经放出去了,多有得罪,那我要开始“正面硬刚”了。

1.一个服务器即可驱动多达7个 LED 处理器!(可能更多?!)

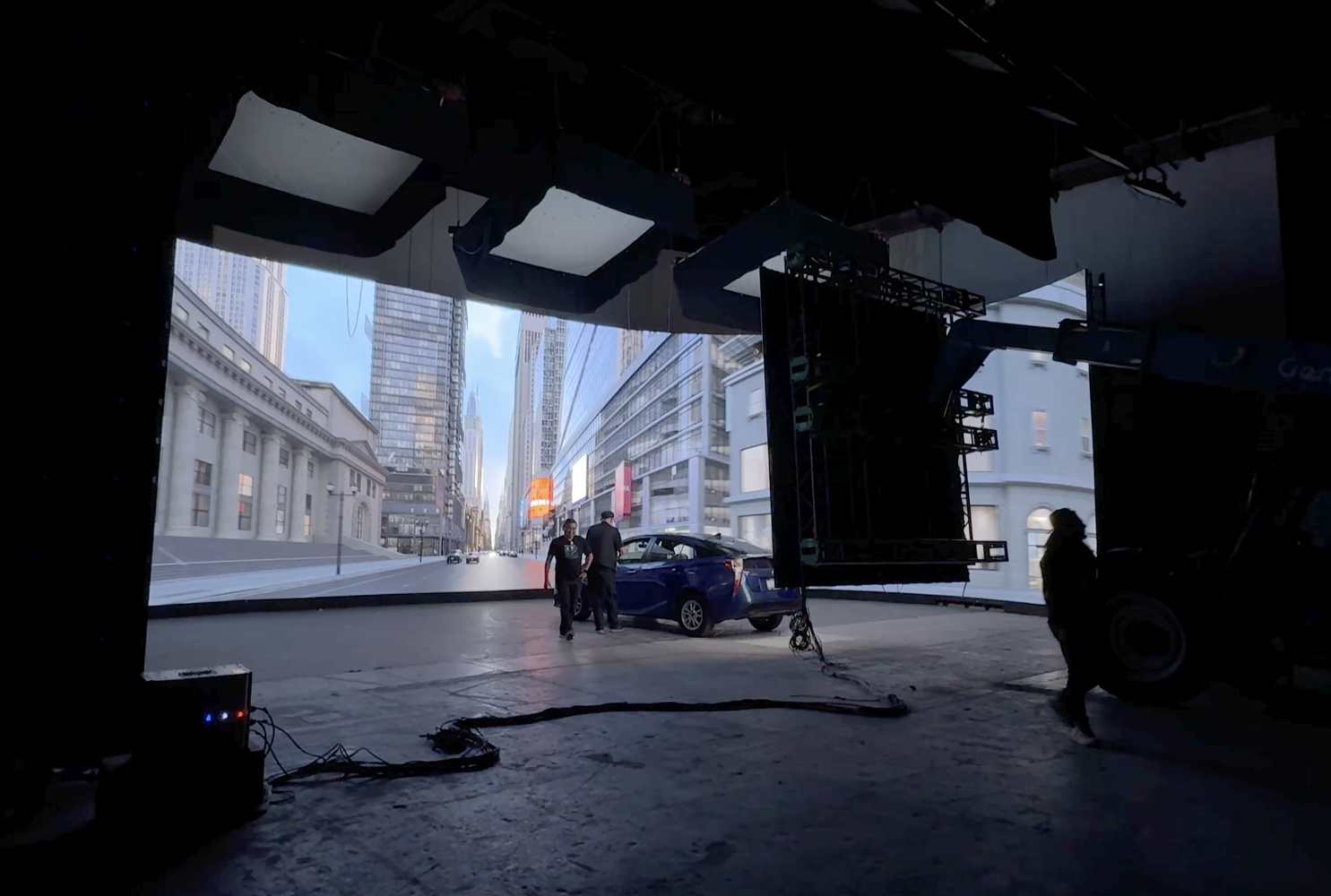

使用现场活动媒体服务器时,一个 LED 处理器就需要一台电脑(或节点),有时候还需要一个额外的节点来控制其他处理器。那么如果你有7个 LED 处理器,那就至少需要7台电脑,加上所有附带的 IT 基础设施。

有了 Live FX 你就可以通过一台电脑运行7个 LED 处理器,这大大降低了成本和系统复杂性。这能带来诸多显而易见的好处,但有的好处是你可能一开始想不到的。

我们已经利用这套设置完成了至少十几个拍摄,目前为止都没出现过问题。

*7个处理器是我们在一台电脑上尝试过的最大数目,Live FX 完全有可能驱动至少8个或甚至更多个 LED 处理器。我希望很快能测试出它的极限!

2.最划算。

尤其是如果你要跨多个节点使用媒体服务器,Live FX 的成本是现场活动媒体服务器成本的零头罢了。即便我们暂且不论硬件,光是使用 Live FX,对比其他服务器,你每年就很可能节省不少开支。

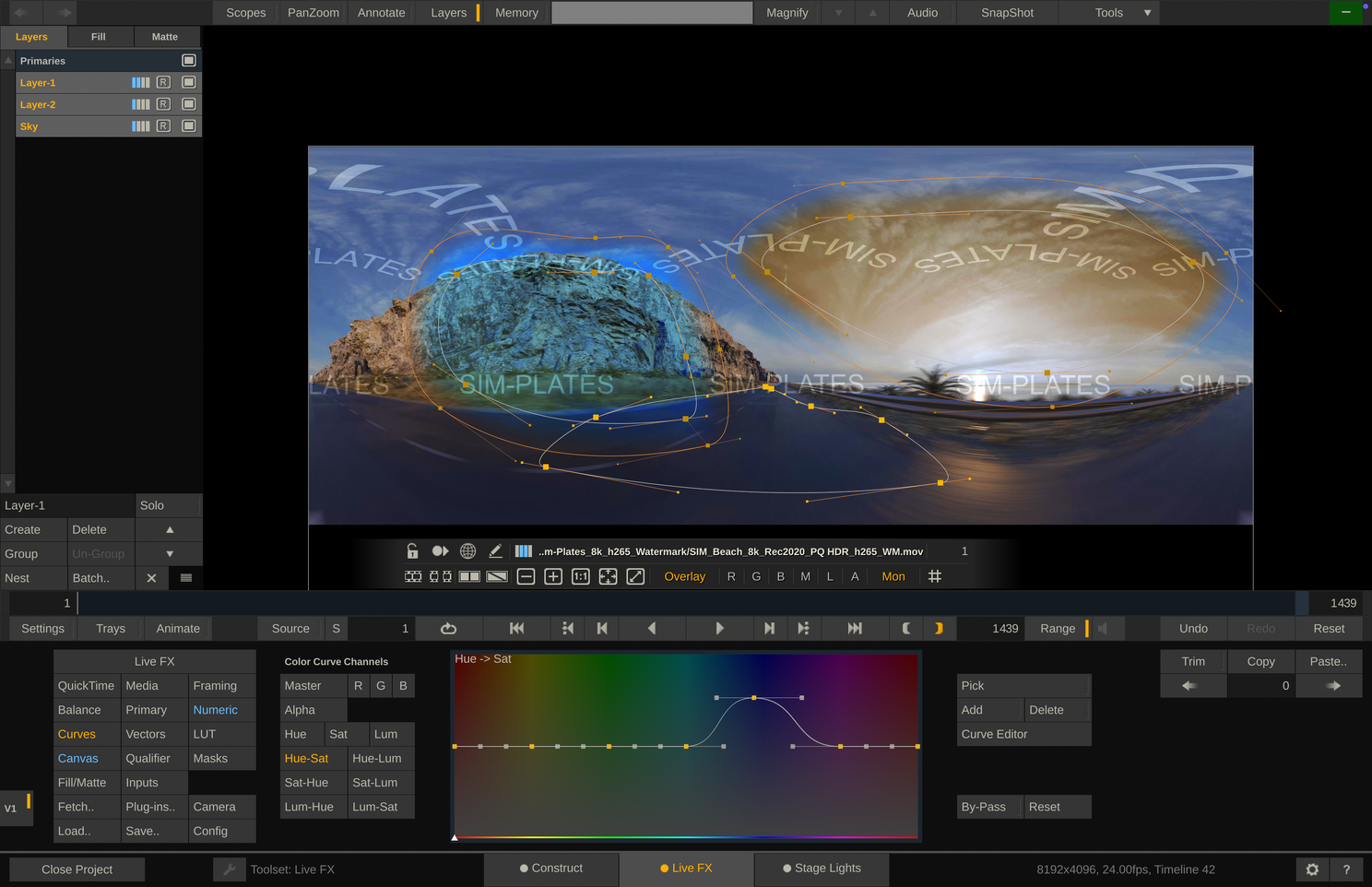

3.色彩管理,使用遮罩实时调色。

Live FX 的核心是 SCRATCH 回放和色彩引擎,其功能已应用到数千个电影、剧集和广告的调色和完成片制作实践中。

这有何重要?因为当拍摄行车场景时,你需要用到类似的处理手法,并在影棚进行实时调色。在影棚进行实时调色的能力极其重要。对于终版调色,电影人绝不会只是给素材套个 LUT 就完事了,而虚拟制作的调色也不该如此。

就算摄影机已经根据 LED 墙做了色彩平衡调整,就算素材已经给一位专业调色师用经过校正的监视器做了完美的平衡处理(话说这种理想情况从未发生过),还是存在很多变量会影响色彩呈现以及色彩看起来应该怎么样,还可能影响任何需要做出的创意决策,所以你需要一切可以掌握的工具。

没有哪个现场活动媒体服务器有专业度足够的内置色彩工具,而你能使用的第三方插件也很有限,你顶多可以调整整个片段的一级调色。

Live FX 当然拥有你想要的所有常规调色工具,比如暗部、中灰、亮部、色调、色温、色相 vs 饱和度、色相 vs 色相、高光滚降等等功能。但更重要的是,你可以使用经过羽化的遮罩,只针对特定局部做调整。

你还可以跟踪素材,设置键控和使用限定器,所有这些几乎都不会影响到软件运行性能。

如果你进行的是多机拍摄,你可以分别对所拍摄的不同部分进行调色。这些都是在拍摄行车场景时至关重要的。

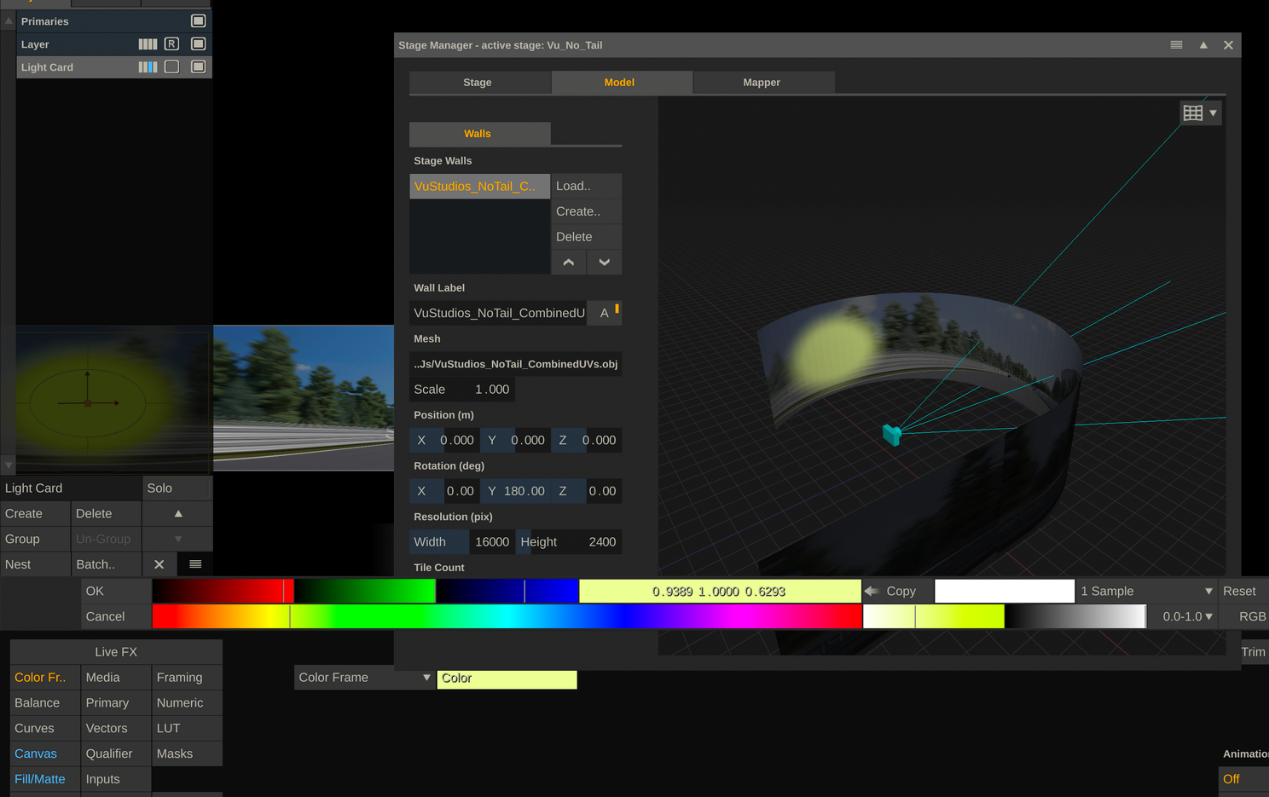

4.Live FX 已然成为基于图像的照明的行业标准。

所有主流灯光编程师和制造商都把 Live FX 用作像素映射和基于图像的照明首选工具绝非凭白无故。在 Live FX 中给照明灯具做像素映射,并通过照明控制台调整灯具是非常简单的,并且全程都能保持色彩准确度。

这意味着,你可以使用 LED 墙的内容辅助场景布光,这对于模拟开车的拍摄尤其重要,比如模拟透过树林的斑驳光线。Live FX 还是唯一一款拥有明确工作流可以妥善映射和控制 LED 灯板(如Kino Flo Mimik)作为光源的软件。

其他媒体服务器会要求你使用 LED 处理器来映射 Mimik,而 Live FX 可以让你不依赖 LED 处理器给 Mimik 做映射和调色。

我曾任林肯公园乐队(Linkin Park)发布的一支MV的虚拟制作总监(根据一份来自约瑟夫·韩-Joseph Hahn 的公开声明,这支 MV 是乐队心目中他们最棒的 MV 之一)。

△ 尊正 CM171+Live FX 助力林肯公园《Up From The Bottom》MV拍摄制作

除了要完成我的虚拟制作总监职责,我还跟摄影指导(DP)和灯光师合作在 Live FX 中给所有灯具编程。

这支 MV 灵动的布光可以说是视频最令人印象深刻的一点,并且 DP 还表示,布光也是他感到最惊艳的东西。

Quasar Science 的“布光虚拟影棚(Lighting Volume)”。大约150盏灯,全都在 Live FX 中进行映射!既可以通过 Silverdraft 主服务器运行,也可以通过一台笔记本电脑驱动。

5.更高速的 HDR 工作流。

我最近在一个影棚里花了30分钟把他们的媒体服务器从 SDR 切换到了 HDR,而这并不是受到影棚或媒体服务器的限制,实际上是受到 Windows/Nvidia 通过 DP 接口处理 HDR 的方式的限制。

因为我们可以通过 SDI 来驱动 LED 墙,因此 Live FX 可以在软件内处理所有色彩转换和 HDR,只花几分钟就能妥善设置。

6.实时网格变形。

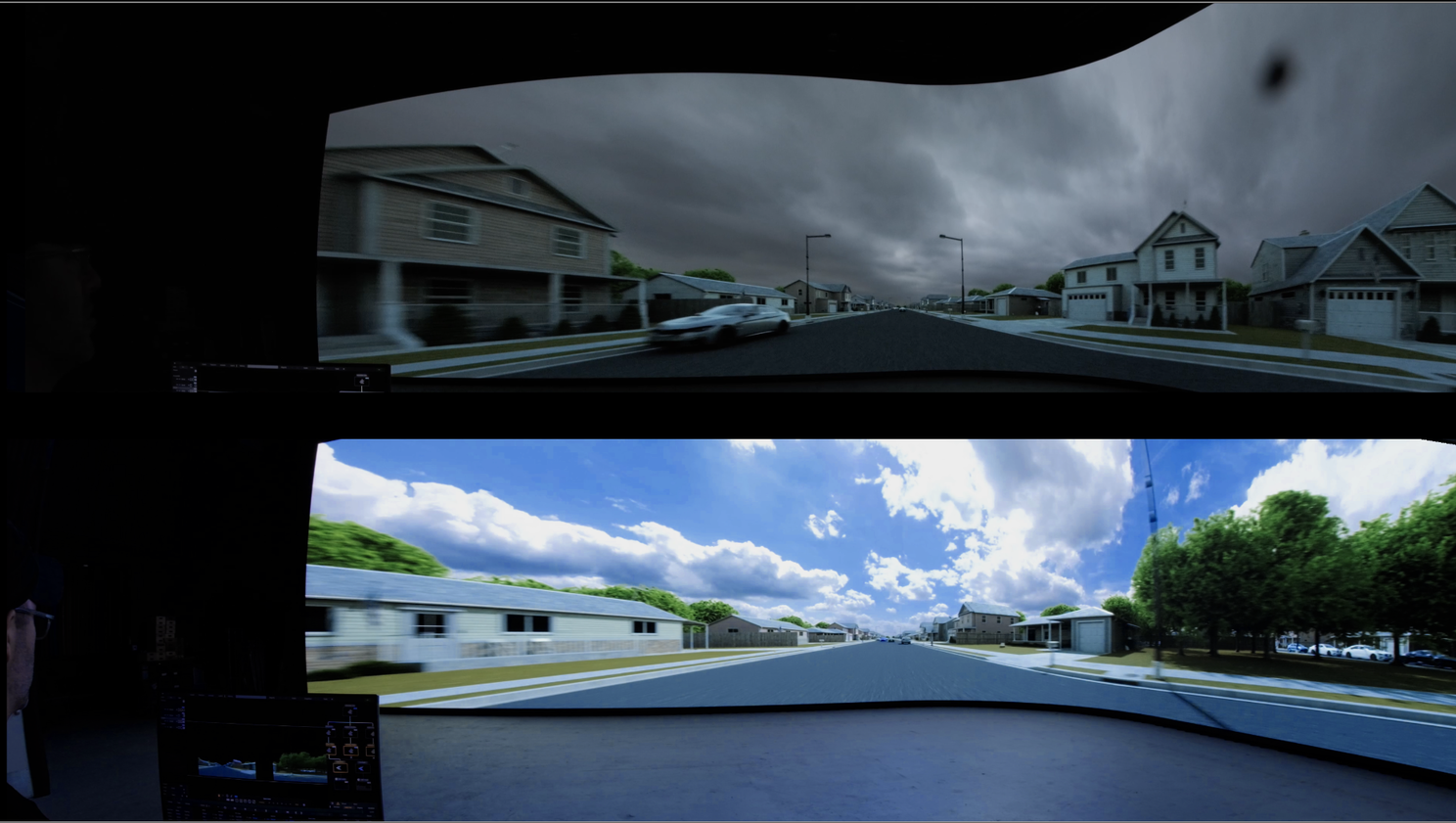

有时候,就算投影映射无误,你必须使用的实拍原档并不那么适合你想要拍摄的角度。那你就可以把这个素材进行实时网格变形,让它看起来正确。

此功能的另一个用例是,如果你的片段不够宽,你可以用网格变形扩展这个视频以适配 LED 墙,而不会出现黑色或其他不匹配内容的东西。

对于天屏,我常会基于天屏的位置和挡风玻璃的形状,用这个功能来让玻璃反光感觉正确,因为需要放大反光的效果看起来才对。

甚至可以对视频进行实时网格变形。当你需要拉伸 2D 内容以填充大型 LED 墙时,这个功能很有用。

7.实时克隆图章。

你可以实时克隆你视频实拍原档中的任意部分,这个功能有一些高级用例。

你可以在虚拟影棚实时对 12K 视频使用此功能,并且不用重渲染!

8.照明卡。

许多现场活动媒体服务器无法添加照明卡或操纵照明卡的色彩或羽化。你还可以为内容本身做一个遮罩,并用内容作为照明卡,可以专门为了布光而把内容的某部分调亮/调色,这也是我通常更喜欢的操作。

简单的照明卡可以是任何形状,甚至可以自定义绘制。如有需,可以将其羽化,或单纯使用形状遮罩来调亮内容,这是一个很灵活的工作流。

9.真正的实时合成。

你可以在一个12K 360视频之上多角度回放 2D 内容,你还可以运用很多高级合成技巧,比如使用 Z深度pass 去影响景深,或使用布光pass 实时为场景重新布光。

10.迄今为止最快开启速度。

当软件程序彻底关闭时,不用10秒就能打开程序,打开已有项目,并开始进行带跟踪的投影映射。Live FX 非常稳定,但如果遇到软件崩溃,不到10秒就能重启并运行软件是一个很棒的功能。

11.可获取任意媒体类型,包括摄影机Raw格式。

可接受 ProRes、任何图像序列(包括EXR序列)、notchLC、Red Raw、Arri Raw、JPEG、.hdr 等等。对于摄影机 Raw 文件,你可以访问完整 SDK,并能操纵 Raw 设置。由于它采用 GPU 加速,你甚至可以使用 Arri Raw 或 Red Raw 来回放!

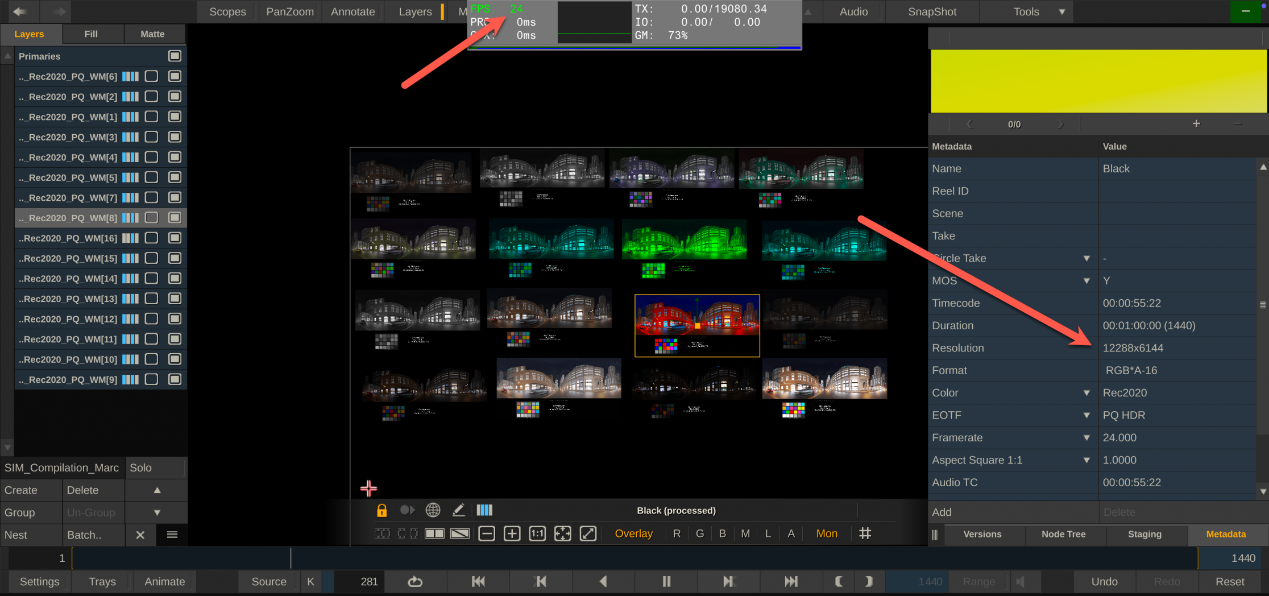

12.唯一一款可以转码 notch 的媒体服务器。Notch LC 极速转码。

NotchLC 是所有媒体服务器视频回放的标准,而 Live FX 是唯一一款可以把素材转码为 NotchLC 的服务器。此外,它比使用 Adobe Media Encoder 编码器的编码速度快5-20倍。每次你需要用它的时候,它能节省好几小时的转码时间。光是这个原因就应该让任何认真从事虚拟制作的影棚去买个 Live FX 许可!我的第一个测试用的是一个12288×6144 ProRes 422文件。结果如下:Media Encoder=25分03秒;Live FX=5分01秒。我接下来的测试用到了8个 Arri Raw 文件,目标是转码为8个单独的文件。Media Encoder 一直转码失败,最终,通过一些试错,我意识到 Media Encoder 在处理 Arri Raw 文件时出于某些原因不能使用 GPU 加速。Media Encoder=7分15秒,烧入LUT;Live FX= 38秒,应用了 OCIO 配置!所以结果是,Live FX 快了11.45倍。

13.超高分辨率!

不限于16K!大部分媒体服务器在每台电脑的分辨率上限是16384×8192,而我成功地在一台电脑上实现了24K EXR 序列转码与24K 回放!

14.设置超快。

使用 SDI 工作流时,由于视频和同步锁相是通过视频 IO 发生的,我们可以绕过所有复杂的Windows/Nvidia 设置,否则它们可能要耗费几个小时来排障和同步。我曾用我在工作车上设置好的 Live FX 服务器驱动一个用了4个 LED 处理器的虚拟影棚,我把我的 SDI 线缆给到影棚的人,花了10分钟做映射,然后我们就准备好可以开拍了!

15.Mac/PC 都可用!

Live FX 可以在 Mac 上运行,并且已为 Apple Silicon 重写编写程序。Mac 相较于 PC 有几个优势,尤其是在处理 ProRes 文件方面(Live FX 也可以在 PC 上处理 ProRes 文件)。同时Mac非常便携,把我的 MacBook Pro 和一个外接 PCIe 扩展盒装进双肩包我就能飞到全球各地处理至少4个 4K LED 处理器(可能还能处理更多个,只是我还没在 Mac 上充分测试过)。

但不仅如此,我还常用一台 PC 来驱动 LED 墙,然后用我运行着 Live FX 的 MacBook Pro 来处理其他所有操作。有时候我会通过 Mac 来运行灯具控制,这样灯光编程师就可以使用主电脑以外单独的一台电脑了。

通常,无论客户给到我什么需要降噪、清理和转码的素材,尤其是当我们已经让画面实时上墙了,我就会用我的 MacBook Pro 去准备所有素材,把它们转码为 Notch 等等。

林肯公园 MV 的其中一个布光设置中,我完全通过 MacBook Pro 无线操作,这样我们就可以在单独一台 PC 上运行 LED 墙。所有这些本来都可以通过一台电脑运行,但能用我的电脑在片场自由走动着控制布光也很不错。

△ 林肯公园 MV 的 LED 虚拟拍摄片场花絮

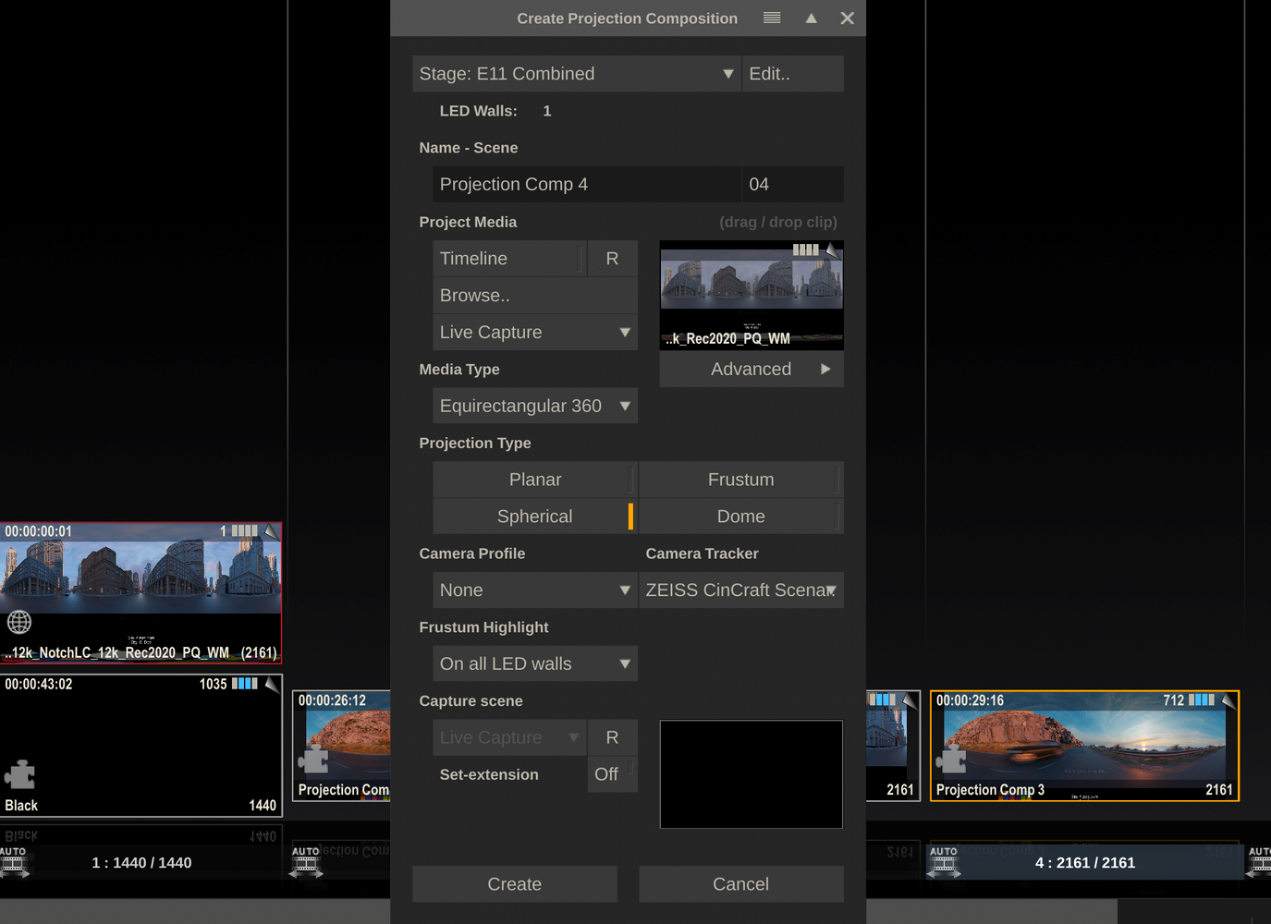

16. 360视频投影映射正确且最快的方式。

在其他服务器中进行投影映射需要一些手动设置,每个镜头要花几分钟。对于10个片段,只是进行回放设置大概要花20分钟。而 Live FX 只要几秒钟就能进行360视频投影映射,甚至是素材的整条时间线。所有设置只用4次点击!

17. 便捷的版本控制。

你可以快速新建一个版本,同时保留所有设置,并可以随时轻松地调出该版本。这看似是个小事,但对于我所参与的每一个拍摄,这个功能都很实用。我可以想到的例子不胜枚举,但有一个非常突出的例子是当你拍完一个设置,转到下一个不同设置,随后又需要回到前一个设置的时候。如果你没办法调出之前的这些设置,那么就不连戏了。另一个例子是,DP 想要尝试几种不同风格,还想能够前后对比 A/B 风格。

不仅新建版本很简单,你还可以轻松地给版本增加色彩标记和添加注释,如有需,这些注释还可以具体到某个时码。

18. 沿用你的现有硬件和 nDisplay 设置。

因为 Live FX 并不依赖硬件,因此你可以使用你现有的(一台或多台)电脑。并且由于你可以在 LED 处理器上使用 SDI 输入,所以你不必在 HDMI 输入上更改现有的 nDisplay 虚幻引擎设置。通常,摄影棚只会选用他们其中一个 UE 渲染节点,插入一个视频 IO 卡,然后就能运行了。因为调色/HDR 设置都在 Live FX 内部进行,你甚至不需要通过 Windows 设置更改任何东西。

19. 视频“影分身”。

Live FX 之所以那么多功能,原因之一是它能给视频做“影分身”,换言之,你可以在画布上把同个视频造出20次,并完全改变它们 —— 各自调色,缩放,增加颗粒,做你想要的任何处理,而软件只会把那个视频读写1次。就算是使用12K 360视频,你也可以同时拥有多个版本,且几乎对软件运行性能没有影响!

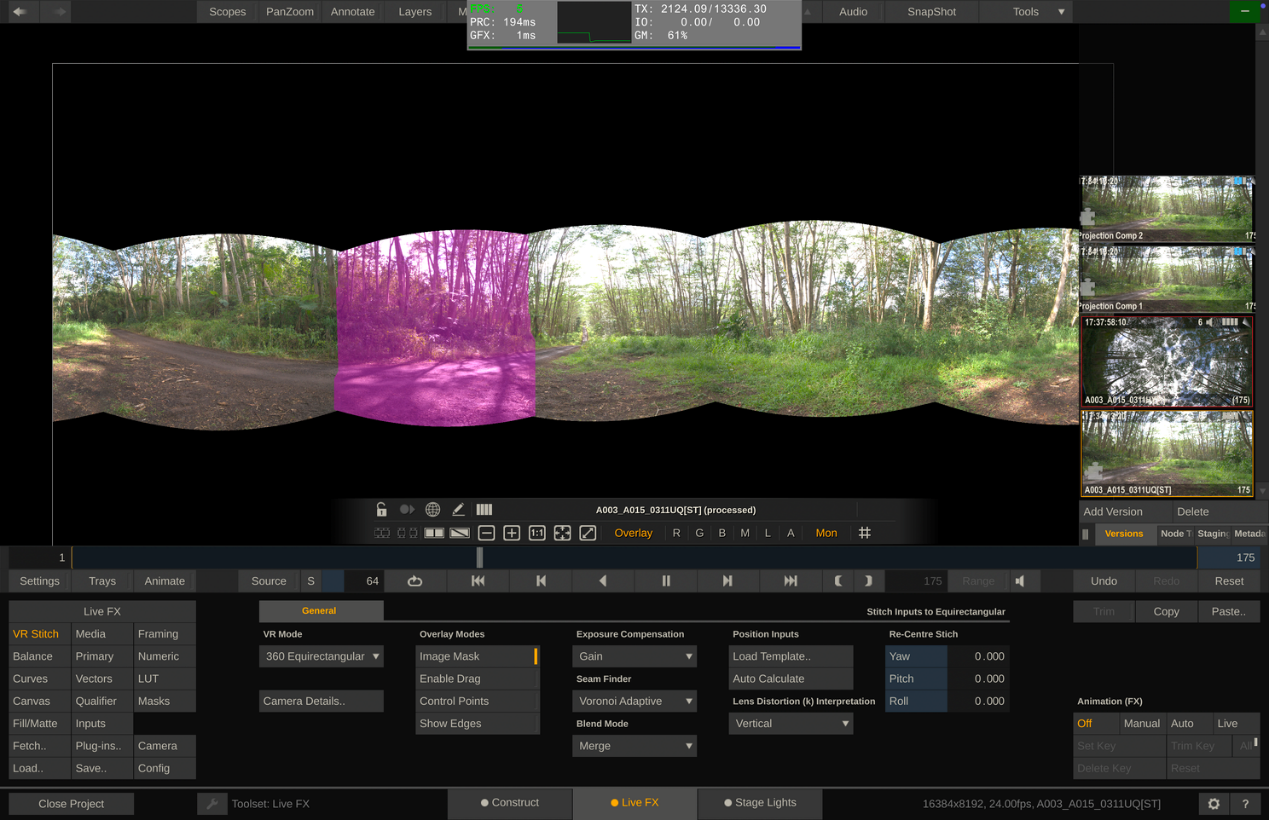

20. 将多个视频拼接为一个360视频。

Live FX 有一个导入 PTGui 文件的方式,并且有一套工作流把素材拼接起来。不仅如此,你还可以手动让它们实时羽化/网格变形,我就曾用这种方式把客户认为“不可能拼接”的实拍原档拼接成功。PTGui/Live FX 并不是拼接一体式360摄影机的最佳工具,Mistika 在这方面赫赫有名,但是,当要拼接自制摄影机装配拍摄的素材时,比如来自实拍原素材公司的那种,Live FX 就有 Mistika 所不敌的几大优势。使用 Mistika 主要是因为他们有卓越的光流技术,但只有当各台摄影机相互距离很近时,才能得到很好的效果,真正只适用于360摄影机。而对于任何自制的摄影机装配,光流伪影通常比简单的羽化还糟糕,所以要在 Mistika 中切换到羽化。那么在这种情况下,你可以在 Live FX 中得到跟 Mistika 类似的效果,但你的工作速度会快得多,而且当你准备好导出时,可以按需直接导出为 NotchLC。

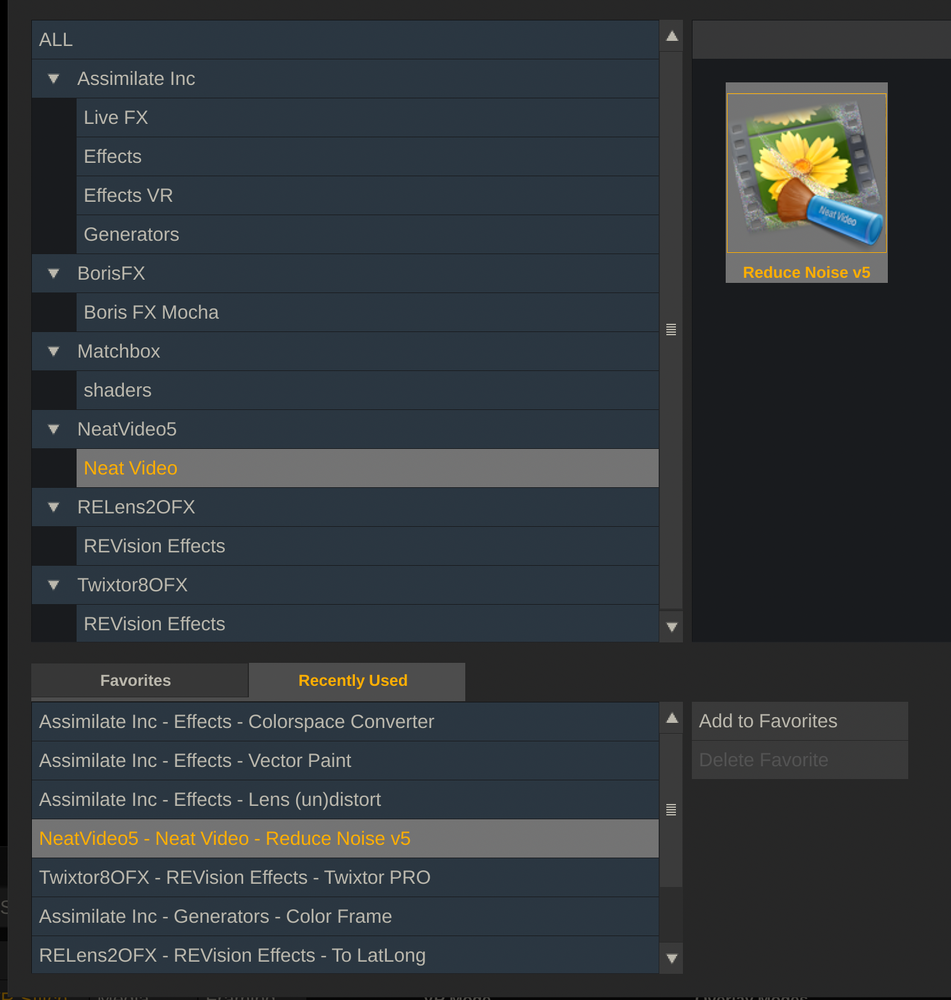

21. Neat Video 降噪。

Neat Video 有一个可以在 Live FX 里直接使用的 OFX 插件,它可以在不离开软件的情况下降噪,更重要的是,直接导出为 Notch 比其他任何工作流有巨大的速度优势。同时还要说的是,在 Live FX 里使用 Neat Video 也比其他任何软件使用 Neat Video 要快得多。

我曾给 12K 素材和甚至是 16K 素材这样做过降噪,EXR 序列 > NotchLC。

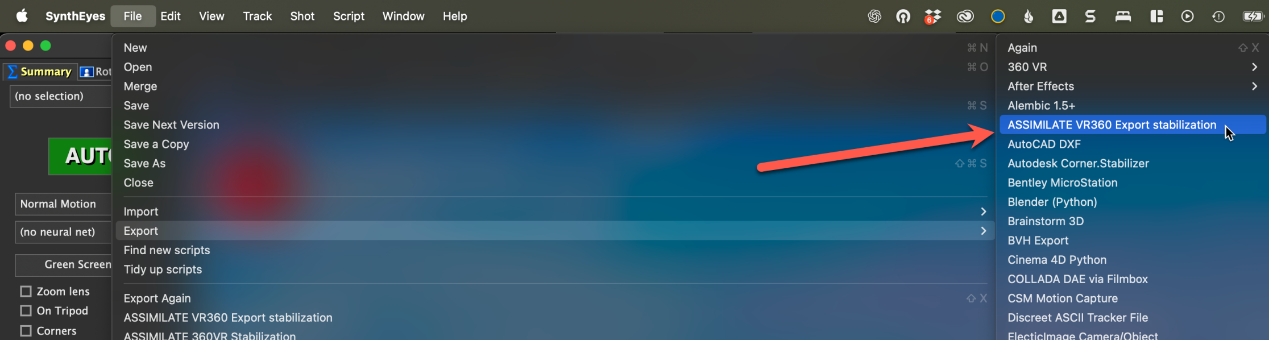

22.SynthEyes 稳定支持。

你可以使用 SynthEyes 来给一个360视频行车镜头做稳定处理,并把关键帧直接导入 Live FX,无需重新转码。

这样每个镜头能省几个小时!

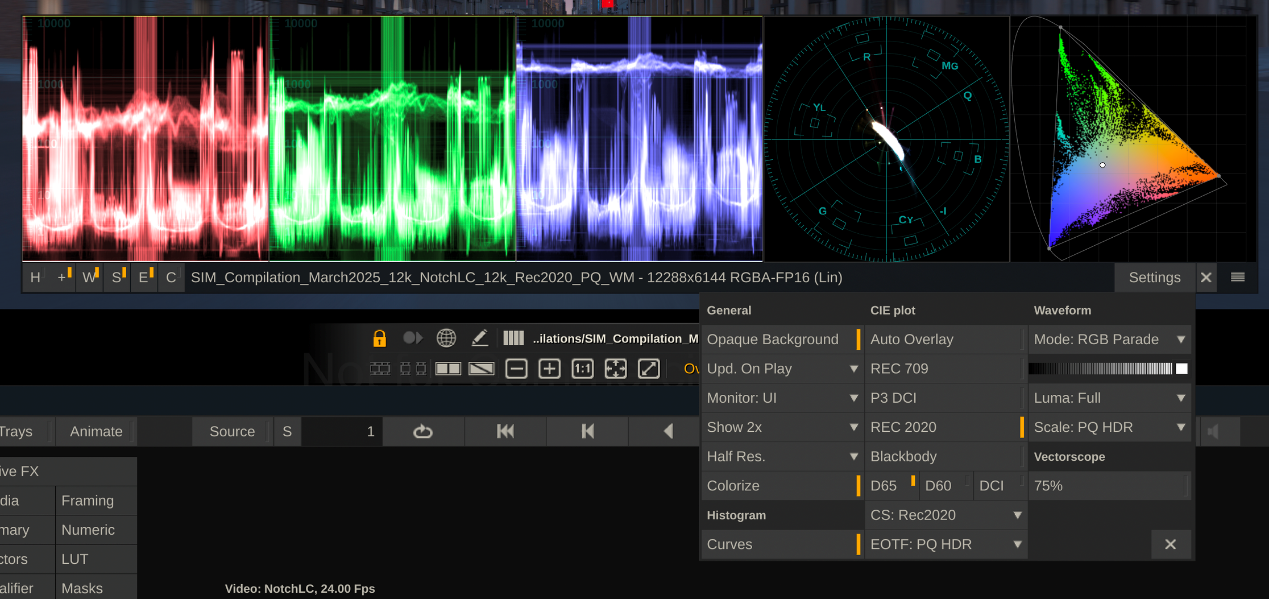

23.示波器。

这看起来是个不起眼的功能,但示波器可以非常有用,尤其是在准备 HDR 素材的时候。如果你的 LED 墙是1500尼特,你还能怎么进行内容母版制作来实现匹配?

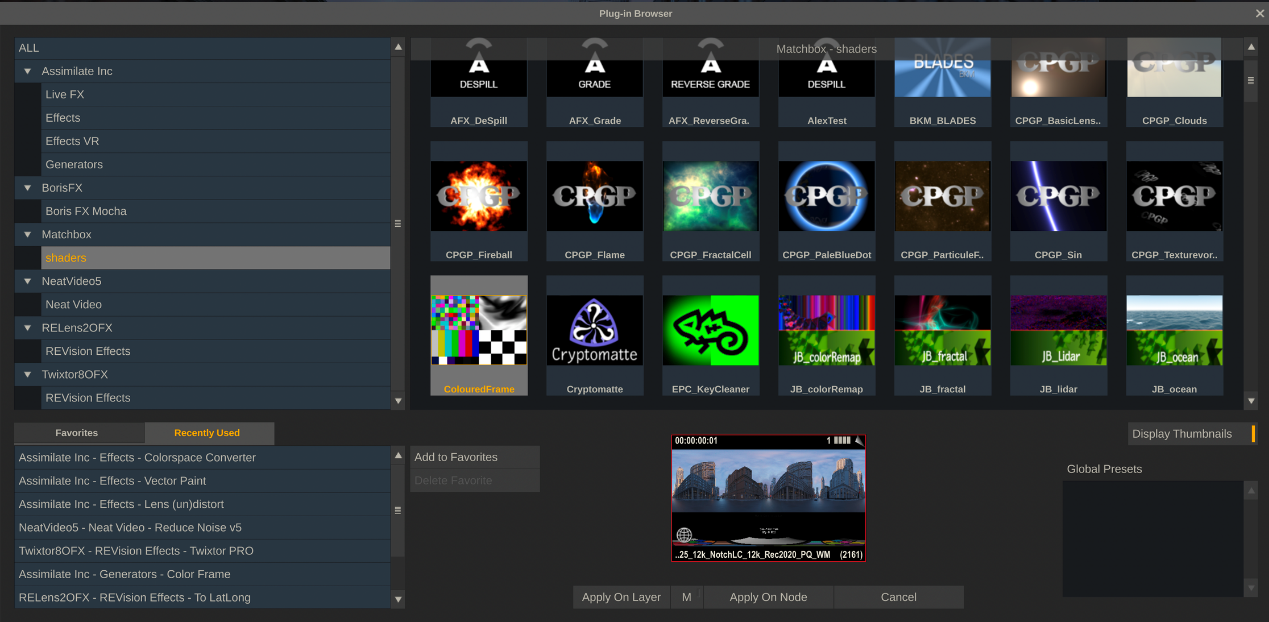

24.Matchbox Shader特效。

Live FX 支持实时 GSL shader 特效(MatchBox),这是一个可用于合成和 IBL 照明的特效库;火、雪、雨等特效都很适合用到行车场景。

25.子帧工作流。

以前 Live FX 总被用到 GhostFrame、子帧和 Mimik 的演示里,现在则用到了 Christie Digital 的演示里,这可不是无缘无故的 —— 它可以从同一台电脑输入和输出很多同步的信号。上周,我们为即将到来的 JB&A 展做准备,我们的设置就类似这样:6路输出+1路摄影机输入到一台电脑。

Red 摄影机信号的 Phantom Track (幻影双录)功能看到一个绿幕背景,而在 Live FX 中我们对绿幕抠像并应用跟踪,在背景里显示出不同内容。

更多细节是这样的:

4路1080,60p 输出通过 SDI 发送给投影仪。1路输出发送给 Megapixel 处理器把特定内容传给 Mimik,1路来自 Red 摄影机的1080p 输入+1路输出给到监视器以显示绿幕合成,合成也是在 Live FX 中实时进行的!再说一次,这些都是在单一一台 Silverdraft 电脑上完成的!

结语

如果你读到了这里,恭喜你!我后续很可能还会继续拓展这篇文章,或者可能新开一篇文章再列25个原因,因为 Live FX 的好处夸不完。

还有很多功能是这里没有提到的,比如 Live FX 跟虚幻引擎之间的工作流,但本文暂且就写到这里了。

出处:Alex Pearce | LinkedIn

翻译:LorianneW | 盖雅翻译小组

-300x152.x33687.jpg)